分布式数据库 UXDB MPP

1.引言

随着海量数据时代的发展,海量数据的管理能力,类型多,变化快,成本低,高可用,可扩展性等需求给企业带来了巨大的挑战。

大数据呈指数增长。结构化数据增长基本可控,随业务增长是线性关系;而对非结构化数据,尤其语音、图像、视频,增长巨大。精准营销、风险控制、运营等对大数据的应用提出更高的要求。

着眼未来,为更好地利用大数据领域新兴技术构造大数据平台,应对市场变幻、带动业务模式创新,寻求新的技术方向已成为必然选择。同时近年来信息安全问题越来越受中国政府和企业的关注,关键领域信息系统的国产化逐步开展。基于信息安全、技术革新等多方面考虑,坚定地走国产化替代道路。

为了应对海量数据时代,优炫软件通过实际应用进行研究、分析,在架构设计、资源管理、功能实现等诸多方面,最终形成了一个适用于PB级的大数据计算的数据库产品——优炫大规模并行处理数据库。

系统架构高可扩展,性能随着节点数的增加而提升,保证客户接入更全面的业务数据,满足市场营销、内部管理、内外监管的分析需求。为用户提供海量数据存储、管理能力,进一步降低客户数据仓库建设的成本,并进一步提升系统性能。

2.概述

-

概念

优炫大规模并行处理uxdb mpp(UXDB Massive Parallel Process)是基于UXDB在多台机器上的横向扩展。这些服务器可以将传入的SQL查询并行化,以便在大型数据集群上实现实时响应,主要功能如下所示。

-

以插件的形式对底层数据库的扩展,并非数据库的分支;

-

通过分片和复制跨多个机器扩展;

-

查询并行化的分布式引擎;

-

用于扩展多租户应用程序的数据库。

-

-

使用场景

-

多租户数据库

大多数多租户应用程序已经有了租户或客户的概念,并将其构建到数据模型中。在此模型中,数据库为多租户提供服务,每个租户的数据都与其他租户分开。uxdb mpp支持对此模型提供标准的SQL,支持将关系型数据库扩展到100K+租户。uxdb mpp还为多租户添加了新功能,例如租户隔离,为大型租户提供性能保证;运用参考表的概念减少租户之间的数据重复。这些功能支持在多台机器上扩展租户数据,能够增加更多CPU、内存和磁盘资源。此外,跨多个租户共享相同数据库模式,能够有效利用硬件资源、方便数据库管理。

-

实时分析

uxdb mpp支持对大型数据集实时查询分析,例如具有亚秒级响应时间的监控图表和当前事物中数据进行探索性分析。

-

-

注意事项

uxdb mpp只扩展UXDB分布式功能,并非扩展UXDB所有功能,因此,uxdb mpp并非适用于所有UXDB集群。选择使用uxdb mpp的集群需要考虑数据模型、工具和SQL的选择。如果使用的数据模型是B2B或者实时分析,并且不考虑其他工具和特殊SQL的支持,那么适合使用uxdb mpp集群。

3.基本概念与原理

3.1.分布式架构

uxdb mpp采用分布式计算架构SN(shared nothing)。多台数据库服务器(节点)形成一个集群,每个节点都是独立、自给的。在系统中不存在单点竞争、没有节点共享存储和磁盘。UXDB可以保存更多数据,比单台机器使用更多CPU,还可以添加更多节点来扩展数据库。

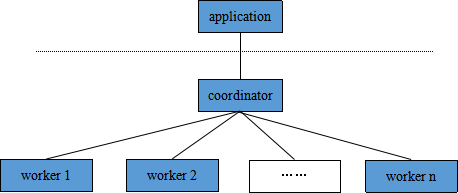

集群中的节点分为两类:一个协调节点(master或者coordinator)和若干工作节点(worker)。应用程序(application)将查询发送给协调节点,协调节点再将查询发送到工作节点上,并收集返回的结果。

对于每个查询,如果数据在单个节点上,那么协调节点将其路由到单个工作节点;如果数据跨多个节点上,那么协调节点将其并行路由到多个节点上。

注意

uxdb mpp支持直接在worker节点上直接进行读写,但不建议在worker节点上直接对跨节点的数据进行操作,这有可能会导致数据错乱。单节点的数据没有影响。

3.2.表类型

uxdb mpp集群中包含以下三种类型的表。

-

分布式表

分布式表是uxdb mpp中最常见的表,将一个表的数据跨多个worker节点水平分区。uxdb mpp使用分片算法将数据行分配给worker节点的碎片,每个节点碎片的总和组成这个节点的所有数据,所有节点的总和组成完整的表的数据。分片需要有一个特定的列值来做标志,用以对这些行进行分配,这个特定的列就叫做分布列,要在分发表的时候指定此列。

-

参考表

参考表也算是一种分布式表,它的所有数据都集中在一个worker节点上的一个碎片上,其他碎片或worker节点上的数据都是它的复制,从任何一个worker节点上都可以访问到表的完整数据,因此不会产生从其他worker请求的网络开销。参考表不用区分每行形成碎片,因此不需要分布列。参考表通常比较小,用于存储和其他worker节点上有关联查询的数据。

-

本地表

使用uxdb mpp实际上是在普通的UXDB数据库的协调节点和与之交互的工作节点安装uxdb mpp扩展,因此,可以在这些节点上创建不进行分片的普通表,比如一些不参与连接查询的小型管理表,这就是本地表。实际上uxdb mpp本身也是使用本地表来保存集群元数据。

3.3.分片

一个分片(shard)指该分布式表在worker节点上的某个小表,即分布式表行的子集。根据分布式规则,一个worker上一般有多个分片(shards)。ux_dist_shard可查看到表的分片信息。

uxdb=#select from ux dist shard;

logicalrelid|shardid|shardstorage|shardminvalue|shardmaxvalue

--+--+--+---+---

employee |102572 |t | -2147483648 | -1073741825

employee |102573 |t | -1073741824 | -1

employee |102574 |t | 0 | 1073741823

employee |102575 |t | 1073741824 | 2147483647

(4行记录)

提示

上例中employee有4个分片,那么数据就会分别写入对应的分片中,可直接从该分片中读取对应的数据。至于这些分片到worker上的映射,即放在哪个worker上,是通过系统的元数据表决定的,可以通过查询表ux_dist_placement和ux_dist_node得出。

SELECT shardid,node.nodename,node.nodeport

FROM ux_dist_placement placement

JOIN ux_dist_node node

ON placement.groupid = node.groupid

AND node.noderole = 'primary'::noderole

WHERE shardid = 102572;

shardid | nodename | nodeport

---+----+

102572 | 192.168.1.83 | 5432

提示

uxdb mpp支持复制分片,以防止数据丢失。

-

分片的意义

根据需要将分片及其副本放在不同的节点上,将包含相关表的相关行的分片放在同一个节点上。这样,它们之间的连接查询可以避免更多的网络消耗,在单节点上就可以执行,提高处理能力。

例如一个具有库存、产品和销售的数据库,如果这三个表都有一个商品id作为分发列进行分片,那么当限制为某一个商品的时候,对于该商品的所有查询可以直接在单个worker上高效的运行,包括这些表之间的联合查询。

另外,跨多台计算机分布查询,可以让多台机器同时执行查询。并且可以通过增加新机器来提高处理速度。实现最大并行性,即最大CPU利用率。

虽然将表分布在多个节点上,以达到查询可以“实时”运行。但是,查询结果仍然需要通过coordinator(或master)节点来进行分发请求命令和收集结果并传回,因此当查询是计数或者统计等聚会函数时,这个加速是最明显的。

3.4.查询处理

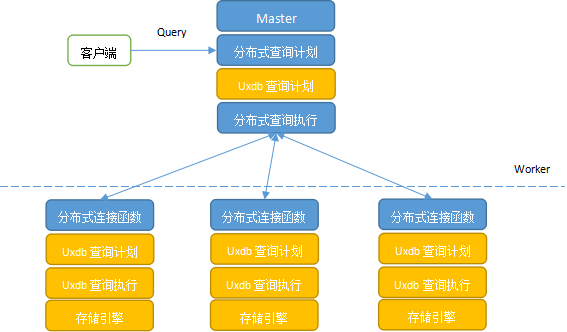

uxdb mpp集群由master实例和多个worker实例组成。master上存储有关分片的元数据,worker上存储分片数据和复制数据。发布到集群上的所有查询通过master执行,master将查询分为较小的查询片段,其中每个查询片段可在分片上独立运行;然后,master将查询片段分配给worker,监督其执行,合并其结果,并最终返回给用户。

uxdb mpp的查询涉及到两个组件:分布式查询计划和执行程序、uxdb查询计划和执行程序。

3.4.1.分布式查询计划程序

uxdb mpp的分布式查询计划程序可对SQL进行查询并计划分布式执行。

对于SELECT查询,计划程序首先创建输入查询的计划树,并将其转化为可交换和关联的形式,以便于并行化。它还应用了一些其他优化,以可伸缩方式执行查询,并最大限度减少网络I/O。

接下来,程序将查询分为两部分,在master运行的查询和在各个worker上运行的查询片段。master将这些查询片段分配给worker,以便有效利用它们的所有资源。在此之后,将分布式查询计划传递给分布式执行程序以供执行。

3.4.2.分布式查询执行程序

uxdb mpp分布式查询执行程序运行分布式查询计划并处理查询执行期间发生的故障。执行程序连接worker节点,将执行任务分配给它们并监督它们执行。如果执行程序无法将任务分配给指定worker执行程序或者任务执行失败,那么执行程序会将该任务重新动态分配给其他worker副本。执行程序处理故障时,只处理查询失败的查询子树,而非处理整个查询。

uxdb mpp默认执行器是adaptive,默认开启。adaptive能快速响应涉及过滤,聚合和亲合连接的查询,也能很好适应具有完全SQL支持的单租户查询。根据需要,为每个分片建立一个连接,将所有的查询分片分配到这些连接上,然后取回各查询分片的查询结果,合并查询结果,最终将查询结果返回用户。

提示

运行UXDB的EXPLAIN命令可以查看查询执行过程。

4.部署和使用

本章介绍如何在linux上进行uxdb mpp的部署和使用。

4.1.部署

4.1.1.手动部署

环境信息

| | IP address | 备注 | | -- | -- | ---- | | master | 192.168.1.82 | 主节点,进行数据操作 | | worker1 | 192.168.1.83 | worker节点,数据分布节点 | | worker2 | 192.168.1.84 | worker节点,数据分布节点 | | …… | | worker节点,数据分布节点 |

注意

各节点的uxdb服务器版本、操作系统、时区时间均应保持一致,且各节点网络相通。本文示例操作系统均为CentOS7.4。

-

安装UXDB

-

分别在master和worker节点上安装uxdb(具体安装过程请参见《优炫数据库管理系统安装手册》)。

-

分别给master和worker节点加载license(联系优炫相关技术人员获取license)。

-

分别在master和worker节点上进入uxdb安装目录的dbsql/bin目录下,初始化集群:./initdb -W -D mpptest。

-

-

配置uxdb mpp

-

修改master和各worker节点的集群配置文件uxsinodb.conf,打开shared_preload_libraries开关,并添加uxdb mpp。

151 shared_preload_libraries ='postgres_adaptor,uxmpp‘注意

当加载多个改变规划器或执行器行为的插件时,请确保uxdb mpp是第一个被加载的。上图所示postgres_adaptor没有改变规划器行为,所以允许放在uxdb mpp之前。

-

-

在master节点上创建.uxpass,并写入worker节点的信息,包括worker节点的IP(不能省略localhost)、集群port、搭建uxdb mpp的数据库名、用户名、密码。

touch ~/.uxpass chmod 0600 ~/.uxpass vi ~/.uxpass #hostname: port: database:username: password localhost:5432:uxdb:uxdb:123456 192.168.1.82:5432:uxdb:uxdb:123456 192.168.1.83:5432:uxdb:uxdb:123456 192.168.1.84:5432:uxdb:uxdb:123456

注意

在.uxpass文件中,前两行master节点的连接信息可不写。如果不写,在连接数据库时,会提示输入密码。

-

在worker1和worker2上分别创建.uxpass,并写入相关信息,如下图(不能省略localhost)。操作命令和master相同。

#hostname: port:database:username:password localhost:5432:uxdb:uxdb:123456 192.168.1.83:5432:uxdb:uxdb:123456 192.168.1.84:5432:uxdb:uxdb:123456 -

分别启动master和worker节点上的集群。

./ux_ctl -D mpptest start -

分别在master和worker节点以需要搭建uxdb mpp的用户登录数据库控制台。

./uxsql -p 5432 -d uxdb -U uxdb -

分别在master和worker节点上控制台中加载uxdb mpp插件。

create extension uxmpp; uxdb=# create extension uxmpp; CREATE EXTENSION uxdb=# \dx List of installed extensions Name | Version | Schema | Description -+----++ pluxsal|1.0 |ux_catalog | PL/uxSQL procedural language uxmpp |7.3-3 |ux_catalog | UXmpp distributed database -

master节点登录控制台添加worker节点。

select master_add_node('192.168.1.83',5432); select master_add_node('192.168.1.84',5432);uxdb=# create extension uxmpp; CREATE EXTENSION uxdb=# select master add node(' 192.168.1.83',5432); master _add node (1 row) uxdb=# select master add node('192.168.1.84',5432); master_add node (1 row) -

master节点上查看在线的worker节点。

select master_get_active_worker_nodes();uxdb=# select master get active worker nodes () ; master get active worker nodes ---- (192.168.1.84,5432) (192.168.1.83,5432) (2行记录)

提示

验证uxdb mpp环境是否搭建成功,可在master上创建一个分布表(创建分布表请参见[创建](#mpptablecreate)),在worker节点上查看是否分布成功。

4.1.2.自动部署

自动部署可以简化部署过程,提高部署效率,减少部署过程中出现的人为错误。

示例节点情况如下:包含一个协调节点,一个执行节点,一个数据节点。

环境信息

| | IP address | 备注 | | - | -- | | | Coordinator | 192.71.0.204 | 管理节点,对各个节点的集群进行部署和配置。可以和其他节点部署在同台机器 | | executor1 | 192.71.0.203 | 执行节点,可进行DML操作 | | …… | …… | …… | | datanode1 | 192.71.0.204 | 数据分布节点 | | …… | …… | …… |

注意

各节点的uxdb服务器版本、操作系统、时区时间均应保持一致,且各节点网络相通。本文示例操作系统均为CentOS7.4。

-

安装ansible

可通过yum或者rpm包进行安装。

yum install ansible -y查看ansible是否安装成功。

[uxdb@uxdev204 ~]$ ansible --version /usr/lib/python2.7/site-packages/ansible/parsing/vault/init__py: 44: CryptographyDeprecationWari and will be removed in the next release. from cryptography.exceptions import InvalidSignature ansible 2.9.27 config file = /etc/ansible/ansible.cfe configured module search path = [u'/home/uxdb/.ansible/plugins/modules'- u'/usr/share/ansible/p. ansible python module location = /usr/lib/python2.7/site-packages/ansible executable location = /usr/bin/ansible python version = 2.7.5 (default, Jun 28 2022, 15:30:04) [GCC 4.8.5 20150623 (Red Hat 4.8.5-44)]在所有其他节点都安装ansible,步骤相同。

-

ssh免密配置认证

以uxdb用户生成公钥,Coordinator节点执行ssh-keygen -t rsa(生成过程中默认回车)。

[uxdb@localhost ~]$ ssh-keygen -t rsa Generating public/private rsa key pair. Enter file in which to save the key (/home/uxdb/.ssh/id_rsa): Enter passphrase (empty for no passphrase): Enter same passphrase again: Your identification has been saved in /home/uxdb/.ssh/id_rsa. Your public key has been saved in /home/uxdb/.ssh/id_rsa.pub. The key fingerprint is: SHA256:29KPK3vT2FexZrdQBFNWKJ8PK5PtCM6V7g99ZsZSN1I uxdb@localhost.localdomain The key's randomart image is: +---[RSA 2048]----+ | . o.o. | | . . . | | + o | | S . . | | +.E o | | +.*o+ B + | | . . B.**og | | . * o=.+*o | | . + o o . | +----[SHA256]-----+同步公钥文件id_rsa.pub到目标主机,如下所示。

ssh-copy-id -i /home/uxdb/.ssh/id_rsa.pub uxdb@192.71.0.204 ssh-copy-id -i /home/uxdb/.ssh/id_rsa.pub uxdb@192.71.0.203验证免密配置是否成功:Coordinator节点上uxdb用户分别执行ssh 192.71.0.204、ssh 192.71.0.203,免密连接则为配置成功。

在其他节点也进行ssh免密配置认证,操作同Coordinator节点。

为各节点root用户同样配置ssh免密环境。

-

协调节点安装UXDB

在Coordinator节点安装uxdb(具体安装过程请参见《优炫数据库管理系统安装手册》)。

-

部署配置

配置各节点信息。

进入Coordinator节点uxdb安装路径下的deploy目录,修改inventory.ini文件,配置各节点IP、集群名称和端口号。

## UXDB engine # 变量重复定义时的生效规则: # 节点变量留空则默认使用全局变量,否则会覆盖全局变量 ############################################################################### ## the master node [uxdb_coordinators] uxdb_coordinator ansible_host=192.168.102.100 clustername=uxdata listen_port=5432 ## the data nodes [uxdb_datanodes] uxdb_datanode101 ansible_host=192.168.102.101 clustername=uxdata listen_port=5432 uxdb_datanode102 ansible_host=192.168.102.102 clustername=uxdata listen_port=5432 installdir=/home/uxdb/datainstall ## the executors [uxdb_executors] uxdb_executor103 ansible_host=192.168.102.103 clustername=uxdata listen_port=5432 uxdb_executor104 ansible_host=192.168.102.104 clustername=uxdata listen_port=5432 installdir=/home/uxdb/execinstall在自动化部署工具中,各种节点的区别如下所示。

-

[uxdb_coordinators]:协调节点,即master节点,不存放实际数据,可以执行DDL,DML

-

[uxdb_datanodes]:数据节点,存放分片表等实际数据

-

[uxdb_executors]:执行节点,既可以存放分片数据,也能执行DML

部署配置字段说明

修改bootstrap.yml文件,根据实际NTP server修改,如Coordinator节点做NTPserver。名称 说明 uxdb_coordinator 节点名称 ansible_host 节点ip clustername 集群名称 listen_port 集群端口 Installdir 具体安装路径 roles: -role:ntp,ntp server:10.10.10.101 -

启动NTP时间同步服务,如下所示。

```

ansible-playbook --verbose bootstrap.yml -k -u root

```

修改group_vars/all.yml文件,配置数据库安装路径和执行路径,如下所示。

```

###############################################################################

# CAUTION: Both of control machine and the orchestrated machines

# The location of our install file is:

# {{ deploy_path }}/{{ installfile }}

###############################################################################

# 基础部署路径

deploy_path: /home/uxdb

# 安装包文件名

installfile: uxdb-install.tar.gz

# 待打包存档的 uxdbinstall 目录

# 包含执行 initdb/ux_ctl/removedb/uxsql 等命令的目录

archivedir: /home/uxdb/uxdbinstall

installdir: /home/uxdb/uxdbinstall

enable_xtfs: false

```

**配置数据库安装路径和执行路径字段说明**

<table>

<thead>

<tr class="header">

<th>名称</th>

<th>说明</th>

</tr>

</thead>

<tbody>

<tr class="odd">

<td>installdir</td>

<td>数据库在各个节点的默认安装路径</td>

</tr>

<tr class="even">

<td>archivedir</td>

<td>分布式安装包的原路径,即已经安装好的主节点数据库路径</td>

</tr>

</tbody>

</table>

修改group_vars/uxdb.yml文件配置集群信息,如下所示。

```

### Database Engine Parameters

# 厂商/产品信息: UXSINO / UXDB

# 集群名称

clustername: uxdata

# 数据库默认密码

default_password: "123456"

# 数据库监听端口

listen_port: 5432

# 共享预加载库 (通常用于并行或适配组件)

shared_preload_libraries: "'uxmpp, postgres_adaptor'"

# UXMPP 复制模式 (通常为流复制)

uxmpp_replication_model: "'streaming'"

### 自动部署相关参数

# 自动部署时创建的数据库名称

database: uxdb

# 自动部署时创建的数据库管理员名称

administrator: uxdb

### 数据库运行模式,支持 [standard] 和 [compatible]

# standard: 标准模式; compatible: 兼容模式

running_mode: standard

```

**配置集群信息字段说明**

<table>

<thead>

<tr class="header">

<th>名称</th>

<th>说明</th>

</tr>

</thead>

<tbody>

<tr class="odd">

<td>ux_data</td>

<td>集群存放路径</td>

</tr>

<tr class="even">

<td>clustername</td>

<td>集群名(会被inventory.ini中的设置覆盖)</td>

</tr>

<tr class="odd">

<td>default_password</td>

<td>默认密码</td>

</tr>

<tr class="even">

<td>listen_port</td>

<td>集群启动端口(会被inventory.ini中的设置覆盖)</td>

</tr>

<tr class="odd">

<td>shared_preload_libraries</td>

<td>加载扩展</td>

</tr>

<tr class="even">

<td>uxmpp_replication_model</td>

<td>复制模式</td>

</tr>

<tr class="odd">

<td>Database</td>

<td>数据库名</td>

</tr>

<tr class="even">

<td>Administrator</td>

<td>管理员名</td>

</tr>

<tr class="odd">

<td>running_mode</td>

<td>运行模式</td>

</tr>

</tbody>

</table>

**注意**

自动化工具默认为部署标准数据库集群,如果希望部署兼容模式集群,需要修改配置文件uxdb.yml如下所示。

```

Database: UXDB

Administrator: UXDB

running_mode: compatible

```

-

分布式安装uxdb

分布式安装数据库,如下所示。

sudo ansible-playbook --verbose deploy.yml 或 cd /home/uxdb/uxdbinstall/deploy/uxdb mpp sudo ./deploympp -d在各个节点上可以查看到uxdb已经从协调节点拷贝安装。

注意

分布式安装和卸载都需要sudo权限。

提示

deploy脚本下的配置文件,只需要在Coordinator节点上配置一次即可,可以将其备份至其他目录,后续再安装其他的版本时,就不需要重新配置了。

-

集群操作

如果数据库版本需要license,需要先在各个节点分别配置(license找优炫相关技术人员获取)。

-

Coordinator节点上进入deploy目录,执行如下命令。

初始化集群

ansible-playbook --verbose initdb.yml启动

ansible-playbook --verbose start.yml重启

ansible-playbook --verbose restart.yml查询状态

ansible-playbook --verbose status.yml停止

ansible-playbook --verbose stop.yml删除

ansible-playbook --verbose removedb.yml -

快捷命令

Coordinator节点上进入deploy目录,使用deploympp工具进行操作,具体使用方法如下所示。

[uxdb@uxdev204 uxmpp]$ ./deploympp -h deploympp: deploy uxmpp Usage: deploympp -d | --deploy 分布式安装,等同于: 'ansible-playbook -v deploy.yml' deploympp -i | --initdb 初始化集群,等同于: 'ansible-playbook -v initdb.yml' deploympp -a | --start 启动集群,等同于: 'ansible-playbook -v start.yml' deploympp -o | --stop 停止集群,等同于: 'ansible-playbook -v stop.yml' deploympp -r | --restart 重启集群,等同于: 'ansible-playbook -v restart.yml' deploympp -u | --status 查看集群状态,等同于: 'ansible-playbook -v status.yml' deploympp -m | --removedb 删除集群,等同于: 'ansible-playbook -v removedb.yml' deploympp -p | --purge 清理节点,等同于: 'ansible-playbook -v purge.yml' deploympp -v | --version 显示工具版本信息 deploympp -h | --help 显示工具帮助页面 [uxdb@uxdev204 uxmpp]$

-

4.1.3.单节点部署

-

安装UXDB

-

在单节点上安装uxdb(具体安装过程请参见《优炫数据库管理系统安装手册》)。

-

加载license(联系优炫相关技术人员获取license)。

-

进入uxdb安装目录的dbsql/bin目录下,初始化集群。

./initdb -W -D mpptest ```sql

-

-

配置uxdb mpp

-

修改集群配置文件uxsinodb.conf,打开shared_preload_libraries开关,并添加uxdb mpp。

-

启动集群。

./ux_ctl -D mpptest start -

搭建uxdb mpp的用户登录数据库控制台。

./uxsql -p 5432 -d uxdb -U uxdb -

在控制台中加载uxdb mpp插件。

create extension uxdb mpp;

如果需要验证uxdb mpp环境是否搭建成功,可以创建一个分布表,创建成功,则搭建成功。

-

4.2.分布式表的应用

4.2.1.创建

-

分布表

-

先定义一个表。

CREATE TABLE github_events( event_id bigint, event_type text, event_public boolean, repo_id bigint, payload jsonb, repo jsonb, actor jsonb, org jsonb, created_at timestamp); -

使用create_distributed_table()函数指定表分发列并创建分片。

SELECT create_distributed_table ('github_events','repo_id');此函数通知uxdb mpp通过repo_id列对表github_events进行分发。根据uxdb mpp.shard_count和uxdb mpp.shard_replication_factor的值在worker上创建分片。总共创建uxdb mpp.shard_count个分片数,并根据uxdb mpp.shard_replication_factor的值进行复制,复制的副本具有和原表相同的表结构,包括模式、索引和约束。

每个分片都有一个唯一的分片ID,但是副本和原表具有相同的分片ID。每个分片在worker节点上是以名为“tablename_shardid”的常规表显示的,其中tablename是分布式表的名称,shardid是该分片的唯一ID。

提示

前面使用的create_distributed_table创建分布式表适用于空表和非空表。在非空表中使用会自动对数据进行分布,并会有相应的提示。

CREATE TABLE series AS SELECT i FROM generate_series(1,1000000) i; SELECT create_distributed_table('series','i');uxdb=#CREATE TABLE series AS SELECT i FROM generate series(1,1000000)i; SELECT 1000000 uxdb=#SELECT create_distributed_table('series','i'); 注意:Copying data from local table... create distributed table (1行记录)注意

非空表的分布式会有数据迁移的操作,因此分发过程中禁止对该表写入数据。如果是挂起的写入,则在数据分发完成之后,按分布式处理。同时,读取也是按分布式处理。

-

协同定位

协同定位是在相同的机器上保留相关信息,用以实现高效的关系操作,有效利用整个数据集的水平可伸缩性。

如需手动控制表的分组,那么在创建分布式表create_distributed_table时使用可选参数colocate_with。该参数默认为default,该值表示将具有相同的分发列类型、分片数和复制因子的表分为一组。如下所示,t1表和t2表分片表分发列类型相同,默认分片数和复制因子,故表t1和t2拥有相同的分组,例如a=1行和m=1的行放在同一个节点上。

CREATE TABLE t1(a int,b char(10)); CREATE TABLE t2(m int,n char(10)); SELECT create_distributed_table('t1','a'); SELECT create_distributed_table('t2','m');如果需要每个表有自己单独的分组,则可以指定colocate_with参数值为none。

SELECT create_distributed_table ('t1','a',colocate_with => 'none');如果共同定位多个表,可以先分配一个表,然后再将其他表放入该表的组中。如下所示。

CREATE TABLE test(id int, id2 int, t text); CREATE TABLE test1(id int, id2 int, t text); CREATE TABLE test2(id int, id2 int, t text); SELECT create_distributed_table('test', 'id'); SELECT create_distributed_table('test1', 'id2', colocate_with=>'test'); SELECT create_distributed_table('test2', 'id2', colocate_with=>'test');提示

表ux_dist_partition中可以看到哪些表分配给哪些组(colocationid字段),有关组的信息可以通过表ux_dist_colocation查看。

-

-

参考表

上述方法是将表分配到多个水平分片中,另一种方法是将表分配到单个分片中并将分片复制到每个worker节点上,这种方式分发的表称为参考表。主要是为了存储多个节点频繁访问的数据。常见的参考表有:需要与较大的分布式表连接的小表;多租户应用中的缺少租户ID列或者与租户无关的表;跨多列的唯一约束的小表。使用create_reference_table()函数创建参考表。

SELECT create_reference_table('tablename');

4.2.2.修改

uxdb mpp会自动传播多种DDL语句。在协调节点(master)上修改表,同时也会更新到对应worker节点上对应的分片表。当然,不是所有的DDL语句都可以传播,有一部分需要手动在各个节点上进行修改,还有一部分目前是不支持的,例如修改分发列。可以通过设置参数uxdb mpp.enable_ddl_propagation来启用或禁止自动传播DDL,默认是启用。

uxdb mpp自动传播大多数ALTER TABLE命令,如修改表名、修改列名、添加列、修改列、删除列、修改列类型,这些操作和在单机版uxdb数据库中是一样的。但是,不建议直接对分布列进行相关修改操作,且分布列不支持列的删除和类型修改。

使用uxdb mpp不影响数据库约束的使用,例如在分布式表上创建主键和外键。

//创建一个货物、订单、库存的关系表

CREATE TABLE goods(gid varchar(20),gname varchar(20),gprice int);

CREATE TABLE orders(oid varchar(20),gid varchar(20),onumber int);

CREATE TABLE stock(sid varchar(20),gid varchar(20),snumber int);

//添加主键(唯一约束必须在分发列之前创建)

ALTER TABLE goods ADD PRIMARY KEY (gid);

ALTER TABLE orders ADD PRIMARY KEY (oid,gid);

ALTER TABLE stock ADD PRIMARY KEY (sid,gid);

//分发表

SELECT create_distributed_table ('goods','gid');

SELECT create_distributed_table ('orders','gid');

SELECT create_distributed_table ('stock','gid');

//添加外键

ALTER TABLE orders ADD CONSTRAINT goods_orders_fk FOREIGN KEY(gid) REFERENCES goods(gid);

ALTER TABLE stock ADD CONSTRAINT goods_stock_fk FOREIGN KEY(gid) REFERENCES goods(gid);

//非空约束

ALTER TABLE orders ALTER COLUMN onumber SET NOT NULL;

uxdb mpp支持添加和删除索引。

CREATE INDEX date_idx ON orders USING BRIN(oid);

DROP INDEX date_idx ;

由于添加索引时会锁定表,所以在uxdb mpp适用的多租户模型中是不可取的。为了避免这种问题,可以使用下述方法创建索引。虽然可能会花费较多时间,但是不会锁定表,因此,对于多租户模型来说是非常有用的。

CREATE INDEX CONCURRENTLY date_idx ON orders USING BRIN(oid);

4.2.3.操作数据

-

插入

要将数据插入分布式表,可以使用标准

INSERT命令。INSERT INTO test VALUES (0,0,'uxsino'); INSERT INTO test VALUES (1,1,'agent'),(2,2,'mpp');给分布式表插入行时,必须指定分发列,即分发列不能为空。数据会根据分发列将数据路由到对应分片上。

还支持批量加载,可以直接使用uxdb的

copy命令:COPY table_name [ ( column_name [, ...] ) ] FROM { 'filename' | PROGRAM 'command' | STDIN } [ [ WITH ] ( option [, ...] ) ]注意

分片没有快照隔离的概念,那么当在

copy的同时进行select,可能会在某些分片上看到copy的数据,但在其他分片上可能没有。如果copy无法连接到其他分片,那么它的行为相当于insert,如果连接到分片发生故障,则回滚事务,不会对元数据进行更改。提示

在很多uxdb mpp数据模型下,对大量数据进行快速查询,需要亚秒级反应。那么快速查询的一种方法就是可以提前计算和保存聚合。例如重复执行一个聚合查询的时,它必须遍历每个相关的行并进行重新计算整个数据集的结果,那么将数据分别汇总到每小时或者每天进行保存,这样就避免了再运行的时候处理原始数据的成本。当聚合的汇总足够多的时候,且不在需要完整的详细信息时候,旧数据则可以被删除,这样也会节省存储空间。

综上所述,需要注意:

-

查询和插入表由类似的列分发

-

选择查询时,条件应该带分布列

-

插入必须包括分布列

-

-

更新

UPDATE [ ONLY ] table_name [ * ] [ [ AS ] alias ] SET { column_name = { expression | DEFAULT } | ( column_name [, ...] ) = [ ROW ] ( { expression | DEFAULT } [, ...] ) | ( column_name [, ...] ) = ( sub-SELECT ) } [, ...] [ FROM from_list ] [ WHERE condition | WHERE CURRENT OF cursor_name ] [ RETURNING * | output_expression [ [ AS ] output_name ] [, ...] ]注意

更新分布式表时,不能修改分布式列。

-

删除

DELETE FROM [ ONLY ] table_name [ * ] [ [ AS ] alias ] [ USING using_list ] [ WHERE condition | WHERE CURRENT OF cursor_name ] [ RETURNING * | output_expression [ [ AS ] output_name ] [, ...] ]

4.2.4.查询

uxdb mpp是一个扩展,扩展了UXDB以实现分布式。那么可以在master上使用标准的UXDB的SELECT查询。uxdb mpp可以并行化复杂的选择、分组、排序以及JOIN的SELECT查询,以加快查询性能。uxdb mpp将SELECT查询分成小的查询片段分配给下面的worker,并将其结果合并返回给用户。

-

聚合查询

uxdb mpp支持并行化uxdb的大多数聚合函数。

uxdb mpp以多种方式支持count(distinct)聚合。如果count(distinct)聚合在分发列上,则可以直接下发到worker;如果没有在分发列上,那么将会在每个worker上运行select distinct语句,然后将结果返回给master,在master上进行最终的count。

注意

对于包含多个count(distinct)聚合查询时,出具传输会很慢,如下所示。

SELECT count(distinct a), count(distinct b), count(distinct c) FROM table_abc; -

join查询

uxdb mpp支持任意数量的表之间的equi-join,并且可以不考虑表的大小和分布方式。查询规划器会根据表的分布方式选择最优的连接方法和连接顺序。并创建一个连接计划,用以使用最小的网络资源传输数据。

当两个表是协同表的时候,它们可以在公共分布列上实现最高效的join连接。这也是分布式表中join连接的最优方法。

注意

join连接要确保表分布到相同数量的分片中,且分发列类型有相应的类型。如果连接不同类型的列(如int和bigint)可能会出现问题。

参考表可用作“维度”表,以便与大表连接。由于参考表是在所有worker节点上完全复制,因此可以将与参考表的连接分解为每个worker上的本地连接,并且可以并行执行。这类似于协同表连接的升级版,因为参考表不用在任何特定的列上分发,并且可以用任何列进行join连接。

4.3.SQL支持

uxdb mpp并非支持所有场景,所以用户在构建应用集群时应该先考虑实际业务场景,目前比较适合的是多租户和实时分析两个场景。

多租户应用程序中,当通过分布列将查询过滤到单个租户的时候,所有的SQL都可以支持。在一般多租户场景下,基本可以支持所有该场景下使用的SQL语句。

在实时分析的场景中,通过跨节点查询,大部分SQL都是支持的,跨节点SQL查询的具体限制如下所示。

-

SELECT … FOR UPDATE仅适用于单分片查询。 -

TABLESAMPLE仅适用于单分片查询。 -

仅当相关位于

Distribution Column时,才支持相关子查询。 -

分布式表之间的外连接仅在 分布列上受支持。

-

仅当分布式表在外侧时,才支持分布式表和引用表或本地表之间的外连接。

-

递归

CTE仅适用于单分片查询。 -

分组集仅适用于单分片查询。

可以使用cte和临时表两种方式,示例如下。

-

CTE解决限制

SELECT * FROM ref LEFT JOIN dist USING (value); ERROR: cannot pushdown the subquery DETAIL: There exist a reference table in the outer part of the outer join要解决此限制,可以通过将部分分布式包装在CTE中,将查询转换为路由器查询。

WITH x AS (SELECT * FROM dist WHERE dist.value > 10) SELECT * FROM ref LEFT JOIN x USING (id);但是协调节点会将CTE结果发送给所有需要处理的节点。因此,最好是尽可能向内部查询添加最具体的筛选条件和限制条件,或者聚合表。这么操作可以减少此类查询可能导致的网络开销。

-

临时表解决限制

即使使用CTE执行,仍会有一些查询不受支持。例如分布式表上使用分组集。创建一个名为github_events的表,由列user_id分发,为查找出最早的管理事件。根据事件类型和事件公开字段组合进行查询即可。但是,如上所述,分布式查询中还不支持此SQL。

SELECT repo_id, event_type, event_public, grouping(event_type, event_public), min(created_at) FROM github_events WHERE repo_id IN (8514, 15435, 19438, 21692) GROUP BY repo_id, ROLLUP(event_type, event_public); ERROR:could not run distributed query with GROUPING HINT:Consider using an equality filter on the distributed table's partition column.解决这个限制,可以使用临时表,如下所示。

//grab the data, minus the aggregate, into a local table CREATE TEMP TABLE results AS ( SELECT repo_id, event_type, event_public, created_at FROM github_events WHERE repo_id IN (8514, 15435, 19438, 21692) ); //now run the aggregate locally SELECT repo_id, event_type, event_public, grouping(event_type, event_public), min(created_at) FROM results GROUP BY repo_id, ROLLUP(event_type, event_public); repo_id | event_type | event_public | grouping | min ----+----+----++- 8514 | PullRequestEvent | t | 0 | 2016-12-01 05:32:54 8514 | IssueCommentEvent | t | 0 | 2016-12-01 05:32:57 19438 | IssueCommentEvent | t | 0 | 2016-12-01 05:48:56 21692 | WatchEvent | t | 0 | 2016-12-01 06:01:23 15435 | WatchEvent | t | 0 | 2016-12-01 05:40:24 21692 | WatchEvent | | 1 | 2016-12-01 06:01:23 15435 | WatchEvent | | 1 | 2016-12-01 05:40:24 8514 | PullRequestEvent | | 1 | 2016-12-01 05:32:54 8514 | IssueCommentEvent | | 1 | 2016-12-01 05:32:57 19438 | IssueCommentEvent | | 1 | 2016-12-01 05:48:56 15435 | | | 3 | 2016-12-01 05:40:24 21692 | | | 3 | 2016-12-01 06:01:23 19438 | | | 3 | 2016-12-01 05:48:56 8514 | | | 3 | 2016-12-01 05:32:54在协调器上创建临时表是最后的手段。它受节点的磁盘大小和CPU的限制。

4.4.函数

4.4.1.表和分片函数

4.4.1.1.create_distributed_table

-

功能

create_distributed_table()函数用于定义分布式表,如果分布方法是哈希,则直接创建分片。此函数参数有表名、分布列和分布方法。其中分布方法为可选参数,默认是哈希分布,哈希分布会根据分片数和复制因子创建分片。如果有数据,并将数据自动分发到worker节点。

-

函数

create_distributed_table('table_name','distributed_column','distributed_method',colocate_with=>'options'); -

参数

create_distributed_table 参数说明

名称 描述 table_name 需要分发的表的名称。 distributed_column 需要分发的列。 distributed_method (可选)分发方法。允许的值是append或hash,默认是hash。 colocate_with (可选)将当前表包含在另一个表的共置位置组中。默认情况下,当表按相同类型的列分布、具有相同的分片计数和相同的复制因子时,表将共存。如果以后要中断此共置,可以使用update_distributed_table_colocation。colocate_with的合法值为:default、none(以启动新的共置组)、或另一个表的名称。 shard_count (可选)要为新分布式表创建的分片数。指定shard_count时,不能将colocate_with的值指定为none以外的值。要更改现有表或共置组的分片计数,请使用 alter_distributed_table 函数。 -

返回值

N/A

-

示例

假设给表github_event通过repo_id列进行分发。

SELECT create_distributed_table('github_events','repo_id');

4.4.1.2.truncate_local_data_after_distributing_table

-

功能

分发表后截断所有本地行,并防止约束因本地记录过时而失败。截断将级联到具有指定表的外键的表。

如果引用表本身不是分布式的,则在它们分布之前禁止截断,以保护引用完整性:ERROR: cannot truncate a tablereferenced in a foreign key constraint by a local table截断本地协调器节点表数据对于分布式表是安全的,因为它们的行(如果有)会在分发过程中复制到工作节点。

-

参数

truncate_local_data_after_distributing_table 参数说明

名称 描述 table_name 应截断其在协调器节点上的本地对应项的分布式表的名称。 -

返回值

N/A

-

示例

//要求参数是分布式表 SELECT truncate_local_data_after_distributing_table('public.github_events');

4.4.1.3.undistribute_table

-

功能

undistribute_table()函数撤消create_distributed_table或create_reference_table的操作。取消分发会将所有数据从分片移回协调器节点上的本地表(假设数据可以容纳),然后删除分片。

uxdb mpp 不会取消分发具有外键或被外键引用的表,除非 cascade_via_foreign_keys 参数设置为true。如果此参数为 false(或省略),则必须在取消分发之前手动删除有冲突的外键约束。

-

参数

undistribute_table 参数说明

名称 描述 table_name 要取消分发的分布式表或引用表的名称。 cascade_via_foreign_keys (可选)当此参数设置为“true”时,undistribute_table还会通过外键取消分布与table_name相关的所有表。请谨慎使用此参数,因为它可能会影响许多表。 -

返回值

N/A

-

示例

此示例分发一个表,然后取消分发该表。

//首先设置表为分布式表 SELECT create_distributed_table('github_events', 'repo_id'); //回退分布操作,使该表重新成为本地表 SELECT undistribute_table('github_events');

4.4.1.4.alter_distributed_table

-

功能

alter_distributed_table()函数可用于更改分布式表的分布列、分片计数或共置属性。

-

参数

alter_distributed_table 参数说明

名称 描述 table_name 将要更改的分布式表的名称。 distribution_column (可选)新分发列的名称。 shard_count (可选)新分片计数。 colocate_with (可选)当前分布式表将与之共置的表。设置值为default、none,用于启动新的共置组;或设置值为另一个表的名称,用于与之共置。 cascade_to_colocated (可选)当此参数设置为“true”时,shard_count和colocate_with更改也将应用于以前与该表共置的所有表,并且将保留共置。如果它是“false”,则此表的当前共置将被破坏。 -

返回值

N/A

-

示例

//修改分布列 SELECT alter_distributed_table('github_events', distribution_column:='event_id'); //修改共置组中所有表的分片数 SELECT alter_distributed_table('github_events', shard_count:=6, cascade_to_colocated:=true); //修改共置组 SELECT alter_distributed_table('github_events', colocate_with:='another_table');

4.4.1.5.alter_table_set_access_method

-

功能

alter_table_set_access_method()函数更改表的访问方法(堆或列式)。

-

参数

alter_table_set_access_method 参数说明

名称 描述 table_name 访问方法将更改的表的名称。 access_method 新访问方法的名称。 -

返回值

N/A

-

示例

SELECT alter_table_set_access_method('github_events', 'columnar');

4.4.1.6.remove_local_tables_from_metadata

-

功能

remove_local_tables_from_metadata()函数从 uxdb mpp的元数据中删除不再需要的本地表。(请参见uxdb mpp.enable_local_reference_table_foreign_keys(boolean))。

通常,如果本地表位于 uxdb mpp的元数据中,说明表和引用表之间存在外键。但是,如果enable_local_reference_foreign_keys禁用,uxdb mpp将不再管理在这种情况下的元数据,并且不必要的元数据可以一直保留,除非手动清理。

-

参数

N/A

-

返回值

N/A

4.4.1.7.create_reference_table

-

功能

create_reference_table()函数用于定义小型参考表或维度表。此函数的参数为表名,创建仅包含一个分片的分布式表,并复制到每个worker节点。

-

函数

create_reference_table('table_name'); -

参数

create_reference_table 参数说明

名称 描述 table_name 需要分发的表的名称。 -

返回值

N/A

-

示例

假设将表test定义为参考表。

SELECT create_reference_table('test');

4.4.1.8.uxdb mpp_add_local_table_to_metadata

-

功能

将一个本地表添加到uxdb mpp 元数据中。此函数的一个主要用法是使协调器上的本地表可从集群中的任何节点访问。这在从其他节点运行查询时很有用。与本表关联的数据保留在协调器上——只有它的模式和元数据被发送给工作器。

请注意,向元数据添加本地表需要付出一些代价。添加表时,uxdb mpp必须在ux_dist_partition表中跟踪它。添加到元数据中的本地表继承了与引用表相同的限制。

如果undistribute_table, uxdb mpp将自动从元数据中删除生成的本地表,这消除了对这些表的限制。

-

参数

uxdb mpp_add_local_table_to_metadata 参数说明

名称 描述 table_name 要添加到uxdb mpp元数据的协调器上的表的名称。 cascade_via_foreign_keys (可选)当此参数设置为“true”时,citus_add_local_table_to_metadata会自动将与给定表有外键关系的其他表添加到元数据中。请谨慎使用此参数,因为它可能会影响许多表。 -

返回值

N/A

-

示例

此示例通知数据库将nation表定义为一个coordinator-local表,可从任何节点访问:

SELECT uxdb mpp_add_local_table_to_metadata('nation');

4.4.1.9.update_distributed_table_colocation

-

功能

update_distributed_table_colocation()函数用于更新分布式表的共置。此函数还可用于中断分布式表的共置。如果分布列是同一类型,uxdb mpp将隐式共置两个表。如果表A和B是共置的,并且表A被重新平衡,则表B也将重新平衡。如果表B没有副本标识,则重新平衡将失败。因此,在这种情况下,此函数可以有效地打破隐式共置。

这两个表必须是哈希分布式表,目前我们不支持APPEND分布式表的共置。请注意,此函数不会在物理上移动任何数据。

-

参数

update_distributed_table_colocation 参数说明

名称 描述 table_name 将更新其共置的表。 colocate_with 待更新的表将会与之共置的表。如果要中断表的共置,则应指定colocate_with => 'none'。 -

返回值

N/A

-

示例

//此示例将table A的共置更新为table B的共置。 SELECT update_distributed_table_colocation('A', colocate_with => 'B'); //假设table A和table B是共置的(可能是隐式的),如果你想打破共置,执行如下命令。 SELECT update_distributed_table_colocation('A', colocate_with => 'none'); //假设当前table A、table B、table C和table D是共置的,如果要拆分,改为分别共置table A和table B,以及table C和table D,执行如下命令。 SELECT update_distributed_table_colocation('C', colocate_with => 'none'); SELECT update_distributed_table_colocation('D', colocate_with => 'C');

4.4.1.10.create_distributed_function

-

功能

将函数从协调器节点传播到工作节点,并将其标记为分布式执行。当在协调器上调用分布式函数时,uxdb mpp使用“分布参数”的值来选取一个工作节点来运行该函数。在工作节点上执行函数可提高并行度,并且可以降低延迟。

请注意,在分布式函数执行期间,uxdb搜索路径不会从协调器传播到工作线程,因此分布式函数代码应完全限定数据库对象的名称。此外,函数发出的通知也不会向用户显示。

-

参数

create_distributed_function 参数说明

名称 描述 function_name 要分发的函数的名称。该名称必须在括号中包含函数的参数类型,因为多个函数在uxdb中可以具有相同的名称。例如,'foo(int)'与'foo(int, text)'是不同的。 distribution_arg_name (可选)要分发的参数名称。允许使用位置占位符,例如'$1'。如果未指定此参数,则函数function_name仅在工作节点上创建。如果将来添加工作节点,则该函数也将自动在新节点创建。 colocate_with (可选)当分布式函数读取或写入分布式表时,请确保使用参数colocate_with命名该表。这可确保函数的每次调用都在包含相关分片的工作节点上运行。 -

返回值

N/A

-

示例

//一个更新表event_responses的示例函数 //该表是以列event_id为分布列的分布表 CREATE OR REPLACE FUNCTION register_for_event(p_event_id int, p_user_id int) RETURNS void LANGUAGE plpgsql AS $fn$ BEGIN INSERT INTO event_responses VALUES ($1, $2, 'yes') ON CONFLICT (event_id, user_id) DO UPDATE SET response = EXCLUDED.response; END; $fn$; //使用p_event_id参数将函数分发到工作节点 //确定每个调用影响哪个碎片 //并显式地与函数更新的表event_responses共享 SELECT create_distributed_function( 'register_for_event(int, int)', 'p_event_id', colocate_with := 'event_responses' );

4.4.1.11.alter_columnar_table_set

-

功能

alter_columnar_table_set()函数可以更改列式表上的设置。在非列式表上调用此函数会产生错误。除表名之外的所有参数都是可选的。

若要查看所有列式表的当前选项,请参阅此表:

SELECT * FROM columnar.options;可以使用以下参数覆盖新创建的表的列式设置的默认值。

-

columnar.compression

-

columnar.compression_level

-

columnar.stripe_row_limit

-

columnar.chunk_row_limit

-

-

参数

alter_columnar_table_set 参数说明

名称 描述 table_name 列式表的名称。 chunk_row_limit (可选)新插入的数据的每个chunk的最大行数。现有数据不会更改,并且可能具有超过此最大值的行数。默认值为10000。 stripe_row_limit (可选)新插入的数据的每个列存条带的最大行数。现有的数据不会更改,并且可能具有超过此最大值的行数。默认值为150000。 compression (可选)[none|pglz|zstd|lz4|lz4hc]新插入数据的压缩类型。不会重新压缩或解压缩现有数据。默认的和通常建议的值为 zstd(如果已编译支持)。 compression_level (可选)有效设置介于 1 到 19 之间。如果压缩方法不支持所选的级别,则将选择最接近的级别。 -

返回值

N/A

-

示例

SELECT alter_columnar_table_set( 'my_columnar_table', compression => 'none', stripe_row_limit => 10000);

4.4.1.12.create_time_partitions

-

功能

create_time_partitions()函数创建给定间隔的分区以覆盖给定的时间范围。

-

参数

create_time_partitions 参数说明

名称 描述 table_name 要为其创建新分区的(regclass)表。该表必须按日期、时间戳或时间戳类型的一列进行分区。 partition_interval 在新分区上设置范围时要使用的时间间隔,如'2 hours'、'1 month'。 end_at (时间戳)所创建分区的截止时间。最后一个分区将包含点end_at,并且不会创建以后的分区。 start_from (时间戳,可选)第一个分区,包含点start_from。缺省值为now()。 -

返回值

如果需要创建新分区,则为 true;如果它们都已存在,则为 false。

-

示例

//在表foo中创建一年的月度分区 //以当前时间为起始时间 SELECT create_time_partitions( table_name := 'foo', partition_interval := '1 month', end_at := now() + '12 months' );

4.4.1.13.drop_old_time_partitions

-

功能

drop_old_time_partitions()函数删除间隔在给定时间戳之前的所有分区。除了使用此函数之外,还可以考虑alter_old_partitions_set_access_method使用列式存储压缩旧分区。

-

参数

drop_old_time_partitions 参数说明

名称 描述 table_name 要为其删除分区的(reg类)表。该表必须按日期、时间戳或时间戳类型的一列进行分区。 older_than (时间戳)删除上限小于或等于older_than的分区。 -

返回值

N/A

-

示例

//删除超过一年的分区 CALL drop_old_time_partitions('foo', now() - interval '12 months');

4.4.1.14.alter_old_partitions_set_access_method

-

功能

在时间序列数据用例中,表通常按时间分区,旧分区压缩为只读列式存储。

-

参数

alter_old_partitions_set_access_method 参数说明

名称 描述 parent_table_name 要更改其分区的(reg类)表。该表必须按日期、时间戳或时间戳类型的一列进行分区。 older_than (时间戳)更改上限范围小于或等于older_than分区。 new_access_method (名称)“堆”表示基于行的存储,或“列式”表示列式存储。 -

返回值

N/A

-

示例

CALL alter_old_partitions_set_access_method('foo', now() - interval '6 months','columnar');

4.4.2.元数据或配置信息函数

4.4.2.1.uxdb mpp_add_node

-

功能

uxdb mpp_add_node()函数在uxdb mpp元数据表ux_dist_node的群集中注册新的节点添加。它还将引用表复制到新节点。

如果在单节点群集上运行,请确保先运行citus_set_coordinator_host。

master_add_node函数与uxdb mpp_add_node使用方式相同。

-

函数

uxdb mpp_add_node('node_name',node_port,group_id,'node_role','node_cluster'); -

参数

uxdb mpp_add_node 参数说明

名称 描述 node_name 要添加的新节点的IP地址。 node_port 要添加的新节点的端口。 group_id (可省略)服务器组,仅与流复制相关。请确保设置为大于零的值,因为零是为协调器节点保留的。默认值为 -1。 node_role (可省略)primary或secondary。默认primary。 node_cluster (可省略)集群名称。默认default。 -

返回值

表ux_dist_node中新插入行中的nodeid列。

-

示例

select * from uxdb mpp_add_node('new-node', 12345); uxdb mpp_add_node -- 7 (1 row)

4.4.2.2.uxdb mpp_update_node

-

功能

uxdb mpp_update_node()函数更改uxdb mpp元数据表ux_dist_node中注册的节点的主机名和端口。

master_update_node函数与uxdb mpp_update_node使用方式相同。

-

函数

uxdb mpp_update_node(node_id,'node_name',node_port); -

参数

uxdb mpp_update_node 参数说明

名称 描述 node_id 需要更新的节点的ID,来自ux_dist_node表的nodeid。 node_name 更新的新节点的IP。 node_port 更新的新节点的端口。 -

返回值

N/A

-

示例

将192.168.1.84:5432节点更新为192.168.1.83:5432。

SELECT * FROM uxdb mpp_update_node(3,'192.168.1.83',5432); uxdb mpp_update_node (1 行记录)

4.4.2.3.uxdb mpp_set_node_property

-

功能

uxdb mpp_set_node_property()函数更改 uxdb mpp元数据表ux_dist_node中的属性。目前,它只能更改shouldhaveshards属性。

函数master_set_node_property与uxdb mpp_set_node_property使用方式相同。

-

参数

uxdb mpp_set_node_property 参数说明

名称 描述 node_name 节点的DNS名称或IP地址。 node_port UXDB在工作节点上侦听的端口。 property 当前仅支持要更改ux_dist_node的shouldhaveshard列。 value 列的新值。 -

返回值

N/A

-

示例

SELECT * FROM uxdb mpp_set_node_property('localhost', 5433, 'shouldhaveshards', false);

4.4.2.4.uxdb mpp_add_inactive_node

-

功能

该uxdb mpp_add_inactive_node函数与[uxdb mpp_add_node()](#uxdb mppaddnode)类似,添加一个新节点。但是,它将新节点标记为非活动状态,即不会在其中放置任何分片。可查看表ux_dist_node的isactive值。也可以使用函数uxdb mpp_add_inactive_node,它们具有相同功能。

master_add_inactive_node函数与uxdb mpp_add_inactive_node使用方式相同。

-

函数

uxdb mpp_add_inactive_node('node_name',node_port); -

参数

表 uxdb mpp_add_inactive_node 参数说明

名称 描述 node_name 要添加的新节点的IP地址。 node_port 要添加的新节点的端口。 group_id (可省略)服务器组,仅与流复制相关。默认值为-1。 node_role (可省略)primary或secondary。默认primary。 node_cluster (可省略)集群名称。默认default。 -

返回值

表ux_dist_node中新插入行中的nodeid列。

-

示例

select * from uxdb mpp_add_inactive_node('new-node', 12345); uxdb mpp_add_inactive_node - 7 (1 row)

4.4.2.5.uxdb mpp_activate_node

-

功能

uxdb mpp_activate_node()函数将uxdb mpp中非活动状态的节点激活。可在[uxdb mpp_add_inactive_node()](#uxdb mppaddinactivenode)函数之后用。

master_activate_node函数与uxdb mpp_activate_node使用方式相同。

-

函数

uxdb mpp_activate_node('node_name',node_port); -

参数

uxdb mpp_activate_node 参数说明

名称 描述 node_name 要激活的节点的IP地址。 node_port 要激活的节点的端口。 -

返回值

表ux_dist_node中新插入行中的nodeid列。

-

示例

select * from uxdb mpp_activate_node('new-node', 12345); uxdb mpp_activate_node -- 7 (1 row)

4.4.2.6.uxdb mpp_disable_node

-

功能

uxdb mpp_disable_node()函数与[uxdb mpp_activate_node()](#uxdb mppactivatenode)函数相反。该函数将活动状态的节点标记为非活动状态,即反激活。

master_disable_node函数与uxdb mpp_disable_node使用方式相同。

-

函数

uxdb mpp_disable_node('node_name',node_port); -

参数

uxdb mpp_disable_node 参数说明

名称 描述 node_name 要反激活的节点的IP地址。 node_port 要反激活的节点的端口。 -

返回值

N/A

-

示例

反激活一个活动状态的节点。

SELECT * FROM uxdb mpp_disable_node('192.168.1.84',5432); uxdb mpp_disable_node - (1 行记录)

4.4.2.7.uxdb mpp_add_secondary_node

-

功能

uxdb mpp_add_secondary_node()函数是给一个现有的主节点新添加一个辅助节点。它将更新表ux_dist_node。

master_add_secondary_node函数与uxdb mpp_add_secondary_node使用方式相同。

-

函数

uxdb mpp_add_secondary_node('node_name',node_port,'primary_name',primary_port,'node_cluster'); -

参数

uxdb mpp_add_secondary_node 参数说明

名称 描述 node_name 要添加的辅助新节点的IP地址。 node_port 要添加的辅助新节点的端口。 primary_name 主节点的IP地址。 primary_port 主节点的端口。 node_cluster 群集名称。默认default。 -

返回值

表ux_dist_node辅助节点的nodeid列。

-

示例

select * from uxdb mpp_add_secondary_node('new-node', 12345, 'primary-node', 12345); uxdb mpp_add_secondary_node -- 7 (1 row)

4.4.2.8.uxdb mpp_remove_node

-

功能

uxdb mpp_remove_node()函数是删除指定的节点。如果删除的节点上存在分片,则此函数会报错。因此,在使用此函数前,需要将分片移出节点。

master_remove_node函数与uxdb mpp_remove_node使用方式相同。

-

函数

uxdb mpp_remove_node('node_name',node_port); -

参数

uxdb mpp_remove_node 参数说明

名称 描述 node_name 要删除的节点的IP地址。 node_port 要删除的节点的端口。 -

返回值

N/A

-

示例

select uxdb mpp_remove_node('new-node', 12345); uxdb mpp_remove_node (1 row)

4.4.2.9.uxdb mpp_get_active_worker_nodes

-

功能

uxdb mpp_get_active_worker_nodes()函数时查看活动状态的节点。

master_get_active_worker_nodes函数与uxdb mpp_get_active_worker_nodes使用方式相同。

-

参数

N/A

-

返回值

处于活动状态的节点列表。

node_name:活动状态的节点IP。

node_port:活动状态的节点端口。

-

示例

SELECT * FROM uxdb mpp_get_active_worker_nodes(); node_name | node_port ----+- 192.168.1.83 | 5432 (1 行记录)

4.4.2.10.uxdb mpp_backend_gpid

-

功能

返回UXDB后台当前会话的全局进程标识符(GPID)。GPID既编码uxdb mpp集群中的节点,也编码该节点上UXDB的操作系统进程号。

uxdb mpp扩展了UXDB服务器信令函数ux_cancel_backend()和ux_terminate_backend(),以便它们接受gpid。在uxdb mpp中,在一个节点上调用这些函数可能会影响在另一个节点上运行的后端。

-

参数

N/A

-

返回值

1个整数形式的GPID,格式为(NodeId * 10,000,000,000)+ProcessId。

-

示例

SELECT uxdb mpp_backend_gpid(); uxdb mpp_backend_gpid 10000002055

4.4.2.11.uxdb mpp_check_cluster_node_health

-

功能

检查所有节点之间的连通性。如果有N个节点,这个函数检查它们之间的所有N2个连接。

-

参数

N/A

-

返回值

每个元组包含以下信息的元组列表:

from_nodename:源工作器节点的DNS名称。

from_nodeport:数据库服务器正在侦听的源工作器节点上的端口。

to_nodename:目标工作器节点的DNS名称。

to_nodeport:数据库服务器正在侦听的目标工作器节点上的端口。

result:是否可以建立连接。

-

示例

SELECT * FROM uxdb mpp_check_cluster_node_health(); from_nodename │ from_nodeport │ to_nodename │ to_nodeport │ result ++---+---+--- localhost | 1400 | localhost | 1400 | t localhost | 1400 | localhost | 1401 | t localhost | 1400 | localhost | 1402 | t localhost | 1401 | localhost | 1400 | t localhost | 1401 | localhost | 1401 | t localhost | 1401 | localhost | 1402 | t localhost | 1402 | localhost | 1400 | t localhost | 1402 | localhost | 1401 | t localhost | 1402 | localhost | 1402 | t (9 rows)

4.4.2.12.uxdb mpp_set_coordinator_host

-

功能

在将工作节点添加到uxdb mpp集群(最初创建为单节点集群)时需要此功能。当协调器注册一个新的工作节点时,它从uxdb mpp的值中添加一个协调器主机名uxdb mpp.local_hostname(text),默认情况下是localhost。工作者将尝试连接到localhost以与协调器通信,这显然是错误的。

因此,在单节点集群中,系统管理员应该在调用uxdb mpp_add_node之前调用uxdb mpp_set_coordinator_host。

-

参数

uxdb mpp_set_coordinator_host 参数说明

名称 描述 host 协调器节点的DNS名称。 port (可选)协调器列出UXDB的端口连接。缺省值为current_setting('port')。 node_role (可选)默认为primary。 node_cluster (可选)默认为 default。 -

返回值

N/A

-

示例

-- 假设我们在一个单节点集群中 -- 首先确定工作节点应该如连接我们 SELECT uxdb mpp_set_coordinator_host('coord.example.com', 5432); -- 然后添加一个工作节点 SELECT * FROM uxdb mpp_add_node('worker1.example.com', 5432);

4.4.2.13.master_get_table_metadata

-

功能

master_get_table_metadata()可用于查看分布式表的相关分布元数据。包括标的oid,存储类型,分发发放,分发列,复制因子。最大分片大小和分片分发策略。

-

函数

master_get_table_metadata('table_name'); -

参数

master_get_table_metadata 参数说明

名称 描述 table_name 要获取分布元数据的分布式表名。 -

返回值

包含以下信息的元组。

logical_relid:分布式表的oid。此值引用ux_class系统目录表中的relfilenode列。

part_storage_type:表的存储类型。可以是't'(标准表),'f'(外部表)或'c'(列存表)。

part_method:表的分发类型。可以是'a'(append)或'h'(hash)。

part_key:表的分发列。

part_replica_count:当前分片复制因子。

part_max_size:当前最大分片大小(以字节为单位)。

part_placement_policy:分片分发策略。可以是1(本地节点优先)或2(循环)。

-

示例

SELECT * FROM master_get_table_metadata('empty'); logical_relid | part_storage_type | part_method | part_key | part_replica_count | part_max_size | part_placement_policy +----+---++++--- 57770 | t | a | id | 1 | 1073741824 | 2 (1 行记录)

4.4.2.14.get_shard_id_for_distribution_column

-

功能

get_shard_id_for_distribution_column()函数根据分发列的值确定给行所在的分片表。该函数在hash分布方式的分布式表上使用。不适用append分布方式。

-

函数

get_shard_id_for_distribution_column('table_name',distribution_value); -

参数

get_shard_id_for_distribution_column 参数说明

名称 描述 table_name 分布式表名。 distribution_value 分发列的值。 -

返回值

shardID:指定分发列的行所在表的分片ID。

-

示例

查看hash分布式表github_events中分布列值为5的行所在的分片表。

SELECT get_shard_id_for_distribution_column('github_events',5); get_shard_id_for_distribution_column --- 102742 (1 行记录)

4.4.2.15.column_to_column_name

-

功能

column_to_column_name()函数查看分布式表的分布列。

-

函数

column_to_column_name(logicalrelid,partkey ) -

参数

column_to_column_name 参数说明

名称 描述 table_name 分布式表名。 -

返回值

distribution_column:指定分布式表的分发列。

-

示例

查看分布式表github_events的分发列。

SELECT column_to_column_name(logicalrelid,partkey )AS dist_col_name FROM ux_dist_partition WHERE logicalrelid = 'github_events' :: regclass ; dist_col_name repo_id (1 行记录)

4.4.2.16.uxdb mpp_relation_size

-

功能

获取指定分布式表的所有分片使用的磁盘空间。这包括“主分叉”的大小,但不包括分片的可见性映射和空闲空间映射。

-

函数

ux_size_pretty(uxdb mpp_relation_size('logicalrelid')); -

参数

uxdb mpp_relation_size 参数说明

名称 描述 logicalrelid 分布式表名。 -

返回值

以字节为单位的大小,以bigint表示。

-

示例

SELECT ux_size_pretty(uxdb mpp_relation_size('github_events')); ux_size_pretty ---- 23 MB

4.4.2.17.uxdb mpp_table_size

-

功能

获取指定分布式表的所有分片使用的磁盘空间,不包括索引(但包括 TOAST、空闲空间映射和可见性映射)。

-

函数

ux_size_pretty(uxdb mpp_table_size('logicalrelid')); -

参数

uxdb mpp_table_size 参数说明

名称 描述 logicalrelid 分布式表名。 -

返回值

以字节为单位的大小,以bigint表示。

-

示例

SELECT ux_size_pretty(uxdb mpp_table_size('github_events')); ux_size_pretty ---- 37 MB

4.4.2.18.uxdb mpp_total_relation_size

-

功能

获取指定分布式表的所有分片使用的总磁盘空间,包括所有索引和TOAST数据。

-

函数

ux_size_pretty(uxdb mpp_total_relation_size('logicalrelid')); -

参数

ux_total_relation_size 参数说明

名称 描述 logicalrelid 分布式表名。 -

返回值

以字节为单位的大小,以bigint表示。

-

示例

SELECT ux_size_pretty(uxdb mpp_total_relation_size('github_events')); ux_size_pretty ---- 73 MB

4.4.2.19.uxdb mpp_stat_statements_reset

-

功能

从uxdb mpp_stat_statements中删除所有行。请注意,这独立于ux_stat_statements_reset().要重置所有状态,请调用这两个函数。

-

函数

uxdb mpp_stat_statements_reset() -

参数

N/A

-

返回值

N/A

-

示例

select uxdb mpp_stat_statements_reset();

4.4.3.集群管理和修复函数

4.4.3.1.uxdb mpp_move_shard_placement

-

功能

此函数将给定的分片(以及与之共置的分片)从一个节点移动到另一个节点。函数通常在分片重新平衡期间间接自动调用,而不是由数据库管理员直接调用。

移动数据有两种方式:阻塞或不阻塞。阻塞意味着在移动过程中,对分片的所有修改都将暂停。不阻塞则避免了阻塞分片写入,依赖于UXDB逻辑复制。

移动操作成功后,源节点中的分片将被删除。如果移动失败,此函数将引发错误,并使源节点和目标节点保持不变。

函数master_move_shard_placement与uxdb mpp_move_shard_placement使用方式相同。

-

参数

uxdb mpp_move_shard_placement 参数说明

名称 描述 shard_id 要移动的分片的 ID。 source_node_name “源”节点的 DNS 名称。 source_node_port 数据库服务器正在侦听的源工作线程节点上的端口。 target_node_name “目标”节点的 DNS 名称。 target_node_port 数据库服务器正在侦听的目标工作线程节点上的端口。 shard_transfer_mode (可选)指定复制方式,是使用 UXDB 逻辑复制还是跨节点 COPY 命令。可以设置的值如下所示。 auto:默认值,等价于block_writes。

block_writes:对缺少主键或副本标识的表使用 COPY(阻塞写入)。

-

返回值

N/A

-

示例

SELECT uxdb mpp_move_shard_placement(12345, 'from_host', 5432, 'to_host', 5432);

4.4.3.2.uxdb mpp_rebalance_start

-

功能

移动表分片,使它们在worker之间均匀分布。它开始后台工作来进行再平衡,并立即返回。再平衡过程首先计算它需要进行的移动列表,以确保集群在给定阈值内实现平衡。然后,它将分片位置从源节点一个接一个地移动到目标节点,并更新相应的分片元数据以反映移动。在确定分片是否“均匀分布”时,为每个分片分配一个成本。默认情况下,每个分片具有相同的成本(值为1),因此分配以均衡工人之间的成本与均衡每个分片上的分片数量相同。常用成本策略称为“by_shard_count”,是默认的再平衡策略。

默认策略适用于以下情况:

-

分片的大小大致相同。

-

分片获得的流量大致相同。

-

工作节点的大小/类型都相同。

-

分片尚未固定到特定工作节点。

如果这些假设中的任何一个都不成立,那么默认的再平衡可能会导致一个糟糕的计划。在这种情况下,您可以使用参数rebalance_strategy自定义策略。建议在运行uxdb mpp_rebalance_start之前调用get_rebalance_table_shards_plan,以查看并验证要执行的操作。

-

-

函数

uxdb mpp_rebalance_start() -

参数

uxdb mpp_rebalance_start 参数说明

名称 描述 threshold (可选)一个介于0.0到1.0之间的浮点数,表示节点利用率与平均利用率的最大差比。例如,指定0.1将导致碎片再平衡器尝试平衡所有节点以保持相同数量的碎片±10%。具体来说,分片再平衡器将尝试将所有工作节点的利用率收敛到(1 - threshold) * average_utilization…(1 + threshold) * average_utilization范围。 drain_only (可选)当为true时,从ux_dist_node表中shouldhashards设置为false的worker节点中移动分片;不要移动其他碎片。 rebalance_strategy (可选)ux_dist_rebalance_strategy表中的策略名称。如果省略此参数,则函数将选择默认策略。 -

返回值

N/A

-

示例

以下示例将尝试在默认阈值内重新平衡分片。

SELECT uxdb mpp_rebalance_start(); NOTICE: Scheduling... NOTICE: Scheduled as job 1337. DETAIL: Rebalance scheduled as background job 1337. HINT: To monitor progress, run: SELECT details FROM uxdb mpp_rebalance_status();

4.4.3.3.uxdb mpp_rebalance_status

-

功能

监控uxdb mpp_rebalance_start()函数的再平衡的进展。

-

函数

uxdb mpp_rebalance_status() -

参数

N/A

-

示例

要获得关于再平衡的一般信息,可以从状态中选择所有列。这显示了工作的基本状态:

SELECT * FROM uxdb mpp_rebalance_status(); . job_id | state | job_type | description | started_at | finished_at | details ---++-+---+-+-+- 4 | running | rebalance | Rebalance colocation group 1 | 2022-08-09 21:57:27.833055+02 | 2022-08-09 21:57:27.833055+02 | { ... }Rebalancer的详细信息以JSON格式存在于details列中:

SELECT details FROM uxdb mpp_rebalance_status(); { "phase": "copy", "phase_index": 1, "phase_count": 3, "last_change":"2022-08-09 21:57:27", "colocations": { "1": { "shard_moves": 30, "shard_moved": 29, "last_move":"2022-08-09 21:57:27" }, "1337": { "shard_moves": 130, "shard_moved": 0 } } }

4.4.3.4.uxdb mpp_rebalance_stop

-

功能

取消正在进行的再平衡(如果有)。

-

函数

uxdb mpp_rebalance_stop() -

参数

N/A

-

返回值

N/A

-

示例

select uxdb mpp_rebalance_stop();

4.4.3.5.uxdb mpp_rebalance_wait

-

功能

调用时将阻塞,直到运行中的再平衡完成。如果在调用uxdb mpp_rebalance_wait()时没有进行再平衡,则该函数立即返回。该函数可用于脚本或基准测试。

-

函数

uxdb mpp_rebalance_wait() -

参数

N/A

-

返回值

N/A

-

示例

select uxdb mpp_rebalance_wait();

4.4.3.6.rebalance_table_shards

-

功能

rebalance_table_shards()函数移动给定表的分片,使它们在工作节点中均匀分布。该函数首先计算它需要进行移动的列表,以确保集群在给定阈值内保持平衡。然后,它将分片逐个从源节点移动到目标节点,并更新相应的分片元数据信息。

在确定分片是否“均匀分布”时,每个分片都会分配一个成本值。默认情况下,每个分片具有相同的成本值(值为1),因此均衡工作节点之间的成本值等同于,均衡每个节点上的分片数量。“by_shard_count”是默认的再平衡策略,该策略下成本值恒定。

-

分片的大小大致相同

-

分片获得的流量大致相同

-

工作节点的大小/类型都相同

-

分片尚未固定到特定工作节点

如果这些假设中的任何一个不成立,那么默认的再平衡策略可能不会得到理想的平衡结果。在这种情况下,可以使用参数rebalance_strategy自定义再平衡策略。

建议在运行rebalance_table_shards之前调用get_rebalance_table_shards_plan,以查看和验证要执行的操作。

-

-

参数

rebalance_table_shards 参数说明

名称 描述 table_name (可选)需要重新平衡其分片的表的名称。如果为 NULL,则重新平衡所有现有的共置组。 threshold (可选)介于 0.0 和 1.0 之间的浮点数,指示节点利用率与平均利用率的最大差值。例如,指定 0.1 将导致分片重新平衡器尝试平衡所有节点以容纳相同数量的分片 ±10%。具体来说,分片重新平衡器将尝试将所有工作节点的利用率收敛到(1 - 阈值)*average_utilization...(1 + 阈值) * average_utilization范围。 max_shard_moves (可选)要移动的最大分片数。 excluded_shard_list (可选)在重新平衡操作期间不应移动的分片标识符。 shard_transfer_mode (可选)指定复制方法,是使用 UXDB 逻辑复制还是跨工作节点 COPY 命令。可能的值包括: auto:默认值,等价于block_writes。

block_writes:对缺少主键或副本标识的表使用 COPY(阻塞写入)。

drain_only (可选)如果为 true,则在工作节点表ux_dist_node中将分片从shouldhaveshards设置为 false 的工作节点上移开;不移动其他分片。 rebalance_strategy (可选)再平衡策略表中的策略名称。如果省略此参数,则该函数将选择默认策略,如表ux_dist_rebalance_strategy中所示。 -

返回值

N/A

-

示例

下面的示例将尝试在默认阈值内重新平衡github_events表的分片。

SELECT rebalance_table_shards('github_events');此示例用法将尝试重新平衡github_events表,而不移动 ID 为 1 和 2的分片。

SELECT rebalance_table_shards('github_events', excluded_shard_list:='{1,2}'); -

备注

该函数已弃用,建议使用uxdb mpp_rebalance_start。

4.4.3.7.get_rebalance_table_shards_plan

-

功能

输出rebalance_table_shards的分片移动计划,但并不实际执行。get_rebalance_table_shards_plan输出的计划可能与rebalance_table_shards略有不同。发生这种情况可能是因为它们不是同时执行的,因为有关群集的物理属性(例如磁盘空间)在两次函数调用之间可能会有变化。

-

参数

与rebalance_table_shards相同的参数:relation、threshold、max_shard_moves、excluded_shard_list和drain_only。有关参数的含义,请参阅该函数的文档。

-

返回值

包含以下列的元组。

-

table_name:分片将移动的表

-

shardid:要移动的分片

-

shard_size:大小(以字节为单位)

-

sourcename:源节点的主机名

-

sourceport:源节点的端口

-

targetname:目标节点的主机名

-

targetport:目标节点的端口

-

4.4.3.8.get_rebalance_progress

-

功能

一旦分片重新平衡开始,get_rebalance_progress()函数就列出涉及的每个分片的进度。它监视uxdb mpp_rebalance_start()计划和执行的移动。

-

参数

N/A

-

返回值

包含以下列的元组。

-

sessionid:再平衡监视器的UXDB PID

-

table_name:分片正在移动的表

-

shardid:要移动的分片

-

shard_size:分片的大小(以字节为单位)

-

sourcename:源节点的主机名

-

sourceport:源节点的端口

-

targetname:目标节点的主机名

-

targetport:目标节点的端口

-

progress: 0 = 等待移动;1 = 移动;2 = 完成

-

source_shard_size:源节点上分片的大小(以字节为单位)

-

target_shard_size:目标节点上分片的大小(以字节为单位)

-

-

示例

SELECT * FROM get_rebalance_progress(); ┌───────────┬────────────┬─────────┬────────────┬───────────────┬────────────┬───────────────┬────────────┬──────────┬───────────────────┬───────────────────┐ │ sessionid │ table_name │ shardid │ shard_size │ sourcename │ sourceport │ targetname │ targetport │ progress │ source_shard_size │ target_shard_size │ ├───────────┼────────────┼─────────┼────────────┼───────────────┼────────────┼───────────────┼────────────┼──────────┼───────────────────┼───────────────────┤ │ 7083 │ foo │ 102008 │ 1204224 │ n1.foobar.com │ 5432 │ n4.foobar.com │ 5432 │ 0 │ 1204224 │ 0 │ │ 7083 │ foo │ 102009 │ 1802240 │ n1.foobar.com │ 5432 │ n4.foobar.com │ 5432 │ 0 │ 1802240 │ 0 │ │ 7083 │ foo │ 102018 │ 614400 │ n2.foobar.com │ 5432 │ n4.foobar.com │ 5432 │ 1 │ 614400 │ 354400 │ │ 7083 │ foo │ 102019 │ 8192 │ n3.foobar.com │ 5432 │ n4.foobar.com │ 5432 │ 2 │ 0 │ 8192 │ └───────────┴────────────┴─────────┴────────────┴───────────────┴────────────┴───────────────┴────────────┴──────────┴───────────────────┴───────────────────┘

4.4.3.9.uxdb mpp_add_rebalance_strategy

-

功能

将一行追加到ux_dist_rebalance_strategy,增加一个新的再平衡策略。

-

参数

uxdb mpp_add_rebalance_strategy 参数说明

名称 描述 name 新策略的标识符。 shard_cost_function 标识用于确定每个分片的“成本”的函数。 node_capacity_function 识别测量节点容量的功能。 shard_allowed_on_node_function 标识确定哪些分片可以放置在哪些节点上的函数。 default_threshold 一个浮点阈值,用于调整节点之间应平衡累积分片成本的精确程度。 minimum_threshold (可选)阈值参数 rebalance_table_shards()所允许的最小值。其默认值为 0。 -

返回值

N/A

4.4.3.10.uxdb mpp_set_default_rebalance_strategy

-

功能

更新再平衡策略表ux_dist_rebalance_strategy,按其参数更改重新平衡分片时选择的默认策略。

-

参数

uxdb mpp_set_default_rebalance_strategy 参数说明

名称 描述 name 策略在ux_dist_rebalance_strategy中的名称。 -

返回值

N/A

-

示例

SELECT uxdb mpp_set_default_rebalance_strategy('by_disk_size');

4.4.3.11.uxdb mpp_remote_connection_stats

-

功能

uxdb mpp_remote_connection_stats()函数显示与每个远程节点的活动连接数。

-

参数

N/A

-

示例

SELECT * from uxdb mpp_remote_connection_stats(); hostname | port | database_name | connection_count_to_node +-++- uxdb mpp_worker_1 | 5432 | uxdb | 3 (1 row)

4.4.3.12.uxdb mpp_drain_node

-

功能

uxdb mpp_drain_node()函数将分片从指定节点,移动到ux_dist_table中shouldhaveshards设置为true 的其他节点上。函数一般在从群集中删除节点之前调用。

-

参数

uxdb mpp_drain_node 参数说明

名称 描述 nodename 要清空的节点的主机名。 nodeport 要清空的节点的端口号。 shard_transfer_mode (可选)指定复制方法,是使用 UXDB逻辑复制还是跨工作线程 COPY 命令。包括的值如下所示。 auto:默认值,等价于block_writes。

block_writes:对缺少主键或副本标识的表使用 COPY(阻止写入)。

rebalance_strategy (可选)再平衡策略表中的策略名称。如果省略此参数,则该函数将选择默认策略。 -

返回值

N/A

-

示例

下面是删除单个节点的一般步骤(例如标准UXDB端口上的“10.0.0.1”)。

- 清空节点。

SELECT * from uxdb mpp_drain_node('10.0.0.1', 5432);-

等到命令完成。

-

删除节点。

排空多个节点时,建议改用rebalance_table_shards。这样做可以让uxdb mpp提前计划并以最少的次数移动分片。

- 对要删除的每个节点运行如下命令。

SELECT * FROM uxdb mpp_set_node_property(node_hostname, node_port, 'shouldhaveshards', false);- 用rebalance_table_shards一次将它们全部清理。

SELECT * FROM rebalance_table_shards(drain_only := true);-

等待再平衡完成。

-

删除节点。

4.4.3.13.isolate_tenant_to_new_shard

-

功能

创建一个新的分片来保存分布列中具有特定单个值的行。它对于多租户uxdb mpp用例特别方便,其中大型租户可以单独放置在自己的分片上,并最终放置在自己的物理节点上。

-

参数

isolate_tenant_to_new_shard 参数说明

名称 描述 table_name 要获取新分片的表的名称。 tenant_id 将分配给新分片的分布列的值。 cascade_option (可选)设置为“CASCADE”时,还会将分片与当前表的共置表中的所有表隔离开来。 -

返回值

shard_id:该函数返回分配给新创建的分片的唯一ID。

-

示例

创建一个新的分片来保存租户 135 的行项:

SELECT isolate_tenant_to_new_shard('lineitem', 135); ┌─────────────────────────────┐ │ isolate_tenant_to_new_shard │ ├─────────────────────────────┤ │ 102240 │ └─────────────────────────────┘

4.4.3.14.uxdb mpp_create_restore_point

-

功能

临时阻止对群集的写入,并在所有节点上创建命名还原点。此功能类似于ux_create_restore_point,但适用于所有节点,并确保还原点在它们之间保持一致。此函数非常适合执行时间点恢复和集群备份。

-

参数

uxdb mpp_create_restore_point 参数说明

名称 描述 name 要创建的还原点的名称。 -

返回值

coordinator_lsn:协调器节点 WAL 中还原点的日志序列号。

-

示例

select uxdb mpp_create_restore_point('foo'); ┌───────────────────────┐ │ uxdb mpp_create_restore_point │ ├──────────────────────┤ │ 0/1EA2808 │ └───────────────────────┘

4.4.3.15.uxdb mpp_copy_shard_placement

-

功能

uxdb mpp_copy_shard_placement()用于修复故障分片。在操作期间导致某个分片变成非活动状态,然后通过该函数将活动的副本分片中的数据拷贝到故障的非活动分片,并使其变成活动状态,以确保新插入的数据分片正常。

master_copy_shard_placement函数与uxdb mpp_copy_shard_placement使用方式相同。

-

函数

uxdb mpp_copy_shard_placement(shard_id,'source_node_name',source_node_port,'target_node_name',target_node_port); -

参数

uxdb mpp_copy_shard_placement 参数说明

名称 描述 shard_id 要修复的分片的ID。 source_node_name 正常的分片所在节点IP(“源”节点)。 source_node_port 正常的分片所在节点IP端口。 target_node_name 故障的分片所在节点IP(“目标”节点)。 target_node_port 故障的分片所在节点端口。 -

返回值

N/A

-

示例

//创建测试表,并设置分片和副本 CREATE TABLE test_table(id int, name varchar(16)); //插入数据 INSERT INTO test_table VALUES(1,'a'),(2,'b'),(3,'c'),(4,'d'); //断开其中一个节点(断网或停止集群)之后,进行写操作 INSERT INTO test_table VALUES(4,'99'); //查看分片分布情况数据shardstate字段值为3表示故障,1表示正常 SELECT * from ux_dist_placement; //恢复上面断开的节点,修复故障 SELECT uxdb mpp_copy_shard_placement(102048, '192.168.1.84', 5432, '192.168.1.83', 5432);注意

修复故障的时候涉及到worker与worker之间数据传输,因此需要将.uxpass文件添加到worker节点的uxdb用户主目录下(可以直接将master上.uxpass复制到各个worker节点)。

4.4.3.16.replicate_table_shards

-

功能

replicate_table_shards()函数复制给定表备份数不足复制因子的分片。该函数首先计算备份不足的分片列表,以及可以从中获取这些分片以进行复制的位置。然后,该函数复制这些分片并更新相应的分片元数据。

-

参数

replicate_table_shards 参数说明

名称 描述 table_name 需要复制其分片的表的名称。 shard_replication_factor (可选)每个分片需要达到备份数(复制因子)。 max_shard_copies (可选)要复制的最大分片数以达到所需的复制因子。 excluded_shard_list (可选)在复制操作期间不进行复制的分片标识符。 -

返回值

N/A

-

示例

下面的示例将尝试以shard_replication_factor复制github_events表的分片。

SELECT replicate_table_shards('github_events');此示例将尝试将github_events表的分片设置为所需的复制因子,最多包含 10个分片副本。这意味着重新平衡器在尝试达到所需的复制因子时最多将只复制10个分片。

SELECT replicate_table_shards('github_events', max_shard_copies:=10);

4.5.元数据表

uxdb mpp根据分发列将每个分布式表划分为多个逻辑分片。master将这些的分片的状态、位置和相关信息统计起来放在对应的元数据表中。可以在master节点通过SQL查看这些表。

4.5.1.time_partitions

-

功能

uxdb mpp 提供 UDF 来管理时间序列数据用例的分区。同时维护一个视图time_partitions来检查它管理的分区。

-

列

time_partitions列说明

名称 描述 parent_table 分区的表。 partition_column 父表分区的列。 partition 分区表的名称。 from_value 此分区中行的时间下限。 to_value 此分区中行的时间上限。 access_method heap行式存储和columnar列式存储。 -

示例

SELECT * FROM time_partitions; ┌──────────────────────┬──────────────┬──────────────────────────────────────┬───────────────────┬───────────────────┬───────────────┐ │ parent_table │ partition_column │ partition │ from_value │ to_value │ access_method │ ├─────────────────────┼──────────────┼──────────────────────────────────────┼───────────────────┼───────────────────┼───────────────┤ │ github_columnar_events │ created_at │ github_columnar_events_p2015_01_01_0000 │ 2015-01-01 00:00:00 │ 2015-01-01 02:00:00 │ columnar │ │ github_columnar_events │ created_at │ github_columnar_events_p2015_01_01_0200 │ 2015-01-01 02:00:00 │ 2015-01-01 04:00:00 │ columnar │ │ github_columnar_events │ created_at │ github_columnar_events_p2015_01_01_0400 │ 2015-01-01 04:00:00 │ 2015-01-01 06:00:00 │ columnar │ │ github_columnar_events │ created_at │ github_columnar_events_p2015_01_01_0600 │ 2015-01-01 06:00:00 │ 2015-01-01 08:00:00 │ heap │ └──────────────────────┴──────────────┴──────────────────────────────────────┴───────────────────┴───────────────────┴───────────────┘

4.5.2.ux_dist_rebalance_strategy

-

功能

此表定义了rebalance_table_shards可用于确定将分片移动到何处的策略。

默认策略by_shard_count,为每个分片分配相同的成本。它的效果是均衡节点之间的分片计数。另一个预定义的策略by_disk_size,将cost分配给与其磁盘大小相匹配的每个分片(以字节为单位),再加上与之共存的分片。磁盘大小是使用ux_total_relation_size计算的,因此它包括索引。此策略尝试在每个节点上实现相同的磁盘空间。请注意阈值0.1,它可防止因磁盘空间的差异而导致的不必要的分片移动。

-

列

ux_dist_rebalance_strategy列说明

名称 类型 描述 name name 策略的唯一名称。 default_strategy boolean 是否是rebalance_table_shards的默认策略。可以使用uxdb mpp_set_default_rebalance_strategy修改此列。 shard_cost_function regproc 成本函数的标识符,它必须将分片作为 bigint,并将其cost返回为real类型。 node_capacity_function regproc 容量函数的标识符,它必须将 nodeid 作为 int,并将其节点容量返回为real类型。 shard_allowed_on_node_function regproc 给定 shardid bigint 和 nodeidarg int 的函数的标识符,返回是否允许将分片存储在节点。 default_threshold float4 将节点视为太满或太空的阈值,rebalance_table_shards将依据此值判断何时应尝试移动分片。 minimum_threshold float4 防止阈值参数的保障措施rebalance_table_shards()设置得太低。 improvement_threshold float4 确定在重新平衡期间何时值得移动分片。重新平衡器在移动分片时,不得超过阈值。这对于by_disk_size策略最有用。 在uxdb mpp安装之后,附带以下策略,如下所示。

SELECT * FROM ux_dist_rebalance_strategy; -[ RECORD 1 ]---+--- name | by_shard_count default_strategy | t shard_cost_function | uxdb mpp_shard_cost_1 node_capacity_function | uxdb mpp_node_capacity_1 shard_allowed_on_node_function | uxdb mpp_shard_allowed_on_node_true default_threshold | 0 minimum_threshold | 0 improvement_threshold | 0 -[ RECORD 2 ]---+--- name | by_disk_size default_strategy | f shard_cost_function | uxdb mpp_shard_cost_by_disk_size node_capacity_function | uxdb mpp_node_capacity_1 shard_allowed_on_node_function | uxdb mpp_shard_allowed_on_node_true default_threshold | 0.1 minimum_threshold | 0.01 improvement_threshold | 0.5

4.5.3.ux_dist_partition

ux_dist_partition存储有关分布表的分布元数据。包括分布方法以及分发列的相关详细信息。

ux_dist_partition元数据表

| 名称 | 类型 | 描述 |

|---|---|---|

| logicalrelid | regclass | 分布式表的表名。 |

| partmethod | char | 分布式表的分布方法,h表示哈希分布,a表示append分布,n表示参考表。 |

| partkey | text | 分发列的详细信息。 |

| colocationid | integer | 此表所属的共址组(请参考协同表),该值引用自ux_dist_colocation表的colocationid列。 |

| repmodel | char | 数据复制的方法。c表示基于SQL语句的复制,s表示流复制。 |

4.5.4.ux_dist_shard

ux_dist_shard存储有关分布式表的各个分片的元数据。包括有关该分片所属的分布式表的信息以及该分片的分发列的统计信息。

ux_dist_shard元数据表

| 名称 | 类型 | 描述 |

|---|---|---|

| logicalrelid | regclass | 分布式表的表名。 |

| shardid | bigint | 分配给分片的唯一标识符。 |

| shardstorage | char | 用于此分片的存储类型。t表示存储常规存储,c表示列存,f表示外部存储。 |

| shardminvalue | text | append:分布列最小值。hash:分布列最小键值。 |

| shardmaxvalue | text | append:分布列最大值。hash:分布列最大键值。 |

4.5.5.ux_dist_placement

ux_dist_placement存储worker节点上的分片和副本的统计信息。

ux_dist_placement元数据表

| 名称 | 类型 | 描述 |

|---|---|---|

| placementid | bigint | 自动生成的唯一标识符。 |

| shardid | bigint | 分片的唯一标识符,该值引用自ux_dist_shard表的shardid列。 |

| shardstate | integer | 碎片状态。1表示活动状态,3表示非活动(故障)状态。 |

| shardlength | bigint | append:分片的大小。hash:为零。 |

| groupid | integer | 节点所在组的唯一标识符,该值引用自ux_dist_node表的groupid列。 |

4.5.6.uxdb mpp_stat_statements

-

功能

用于统计查询是如何执行的以及为谁执行的。

类似于ux_stat_statements(并且可以与之联接),后者跟踪有关查询速度的统计信息。此视图可以跟踪查询到多租户应用程序中的原始租户,这有助于决定何时执行租户隔离。

-

列

uxdb mpp_stat_statements列说明

名称 类型 描述 queryid bigint 标识符(适用于ux_stat_statements 联接) userid oid 运行查询的用户 dbid oid 协调节点的数据库id query text 查询字符串 executor text uxmpp执行人adaptive,or insert-select partition_key text 路由器执行的查询中分布列的值,else为NULL calls bigint 运行查询的次数 -

示例

-- create and populate distributed table create table foo ( id int ); select create_distributed_table('foo', 'id'); insert into foo select generate_series(1,100); -- enable stats -- ux_stat_statements must be in shared_preload libraries create extension ux_stat_statements; select count(*) from foo; select * from foo where id = 42; select * from uxdb mpp_stat_statements; Results: -[ RECORD 1 ]-+- queryid | -909556869173432820 userid | 10 dbid | 13340 query | insert into foo select generate_series($1,$2) executor | insert-select partition_key | calls | 1 -[ RECORD 2 ]-+- queryid | 3919808845681956665 userid | 10 dbid | 13340 query | select count(*) from foo; executor | adaptive partition_key | calls | 1 -[ RECORD 3 ]-+- queryid | 5351346905785208738 userid | 10 dbid | 13340 query | select * from foo where id = $1 executor | adaptive partition_key | 42 calls | 1 -

注意事项

-

统计数据不会被复制,并且无法在数据库崩溃或故障切换中幸存。

-

跟踪有限数量的查询,由GUC参数 ux_stat_statements.max(默认5000)设置。

-

要截断表,请使用 uxdb mpp_stat_statements_reset()函数。

-

4.5.7.ux_dist_node

ux_dist_node存储worker节点的信息。

ux_dist_node元数据表

| 名称 | 类型 | 描述 |

|---|---|---|

| nodeid | integer | 自动生成的单个节点的唯一标识符。 |

| groupid | integer | 节点所在组的唯一标识符,通常和nodeid一样。 |

| nodename | text | 节点IP。 |

| nodeport | integer | 节点端口。 |

| noderack | text | (可选)worker节点位置信息。 |

| hasmetadata | boolean | 保留字段。 |

| isactive | boolean | 节点活动状态。 |

| noderole | noderole | 节点级别。primary或secondary。 |

| nodecluster | text | 节点集群名称。(需要手动添加,默认是default)。 |

| metadatasynced | boolean | 显示此节点是否具有最新的元数据。 |

| shouldhaveshards | boolean | 显示此节点是否具有资格包含分布表的数据。 |

4.5.8.ux_dist_colocation

ux_dist_colocation存储协同表的相关信息。

ux_dist_colocation元数据表

| 名称 | 类型 | 描述 |

|---|---|---|

| colocationid | integer | 协同组的唯一标识符。 |

| shardcount | integer | 协同表的分片数。 |

| replicationfactor | integer | 协同表的复制因子。 |

| distributioncolumntype | oid | 分发列的分发类型代码。 |

| distributioncolumncollation | oid | 协同表分发列的排序代码。 |

4.5.9.uxdb mpp_dist_stat_activity

-

功能

显示在所有节点上执行的分布式查询ux_stat_activity的超集。

-

示例

考虑对分布式表中的行进行计数,如下所示。

//run from worker on localhost:9701 SELECT count(*) FROM users_table;我们可以在uxdb mpp_dist_stat_activity看到查询记录出现,如下所示。

SELECT * FROM uxdb mpp_dist_stat_activity; -[ RECORD 1 ]+---- query_hostname | localhost query_hostport | 9701 master_query_host_name | localhost master_query_host_port | 9701 transaction_number | 1 transaction_stamp | 2018-10-05 13:27:20.691907+03 datid | 12630 datname | uxdb pid | 23723 usesysid | 10 usename | uxdb mpp application_name | uxsql client_addr | client_hostname | client_port | -1 backend_start | 2018-10-05 13:27:14.419905+03 xact_start | 2018-10-05 13:27:16.362887+03 query_start | 2018-10-05 13:27:20.682452+03 state_change | 2018-10-05 13:27:20.896546+03 wait_event_type | Client wait_event | ClientRead state | idle in transaction backend_xid | backend_xmin | query | SELECT count(*) FROM users_table; backend_type | client backend

4.5.10.uxdb mpp_lock_waits

-

功能

阻止整个群集中的查询。

-

示例

要了解它是如何工作的,我们可以手动生成锁定情况。首先,在协调节点创建测试表,如下所示。

CREATE TABLE numbers AS SELECT i, 0 AS j FROM generate_series(1,10) AS i; SELECT create_distributed_table('numbers', 'i');然后,在协调节点上使用两个会话,我们可以运行以下语句序列,如下所示。

//会话1 -- BEGIN; UPDATE numbers SET j = 2 WHERE i = 1; //会话2 -- BEGIN; UPDATE numbers SET j = 3 WHERE i = 1; //(阻塞)查看视图uxdb mpp_lock_waits。

SELECT * FROM uxdb mpp_lock_waits; -[ RECORD 1 ]+ waiting_pid | 88624 blocking_pid | 88615 blocked_statement | UPDATE numbers SET j = 3 WHERE i = 1; current_statement_in_blocking_process | UPDATE numbers SET j = 2 WHERE i = 1; waiting_node_id | 0 blocking_node_id | 0 waiting_node_name | coordinator_host blocking_node_name | coordinator_host waiting_node_port | 5432 blocking_node_port | 5432在此示例中,查询源自协调器。同样的,视图uxdb mpp_lock_waits也可以列出源自工作节点的查询之间的锁,不再列举。

4.5.11.uxdb mpp_shards

-

功能

除了上面描述的低级分片元数据表之外,uxdb mpp 还提供了一个视图uxdb mpp_shards,可以用于查看分片相关信息,包括内容如下所示。

-

每个分片的所在位置(节点和端口)

-

属于哪种表

-

分片大小

通过此视图,可以方便地分析节点之间的大小不平衡。

-

-

示例

SELECT * FROM uxdb mpp_shards; table_name | shardid | shard_name | uxdb mpp_table_type | colocation_id | nodename | nodeport | shard_size --+----+----+---++-++-- dist | 102170 | dist_102170 | distributed | 34 | localhost | 9701 | 90677248 dist | 102171 | dist_102171 | distributed | 34 | localhost | 9702 | 90619904 dist | 102172 | dist_102172 | distributed | 34 | localhost | 9701 | 90701824 dist | 102173 | dist_102173 | distributed | 34 | localhost | 9702 | 90693632 ref | 102174 | ref_102174 | reference | 2 | localhost | 9701 | 8192 ref | 102174 | ref_102174 | reference | 2 | localhost | 9702 | 8192 dist2 | 102175 | dist2_102175 | distributed | 34 | localhost | 9701 | 933888 dist2 | 102176 | dist2_102176 | distributed | 34 | localhost | 9702 | 950272 dist2 | 102177 | dist2_102177 | distributed | 34 | localhost | 9701 | 942080 dist2 | 102178 | dist2_102178 | distributed | 34 | localhost | 9702 | 933888其中,colocation_id是指共置组。

4.5.12.uxdb mpp_tables

-

功能

视图uxdb mpp_tables显示 uxdb mpp 管理的所有表(分布式表和参考表)的摘要。该视图合并了 uxdb mpp元数据表中的信息,用户可以更方便地了解uxdb mpp表的相关属性。

-

列

uxdb mpp_tables列说明

名称 描述 table_name 表名 uxmpp_table_type 表类型 colocation_id 共置组 ID table_size 表大小 shard_count 分片数 table_owner 所有者(数据库用户) access_method 访问方法(堆或列式) -

示例

SELECT * FROM uxdb mpp_tables; ┌───────────┬─────────────┬────────────────┬───────────┬────────┬──────────┬──────────┬─────────────┐ │ table_name │ uxdb mpp_table_type │ distribution_column │ colocation_id │ table_size │ shard_count │ table_owner │ access_method │ ├──────────┼─────────────┼────────────────┼───────────┼────────┼──────────┼──────────┼─────────────┤ │ foo.test │ distributed │ test_column │ 1 │ 0 bytes │ 32 │ uxdb mpp │ heap │ │ ref │ reference │ <none> │ 2 │ 24 GB │ 1 │ uxdb mpp │ heap │ │ test │ distributed │ id │ 1 │ 248 TB │ 32 │ uxdb mpp │ heap │ └───────────┴─────────────┴────────────────┴───────────┴─────────┴──────────┴──────────┴────────────┘

4.5.13.uxdb mpp.ux_dist_object

-

功能

表ux_dist_object包含已在协调器节点上创建,并传播到工作节点的对象列表,例如类型和函数。当管理员将新的工作节点添加到群集时,uxdb mpp会自动在新节点上创建分布式对象的副本。

-

列

uxdb mpp.ux_dist_object列说明

名称 类型 描述 classid oid 分布式对象的类 objid oid 分布式对象的对象 ID objsubid integer 分布式对象的对象子 ID,例如 attnum type text uxdb升级期间使用的稳定地址的一部分 object_names text[] uxdb升级期间使用的稳定地址的一部分 object_args text[] uxdb升级期间使用的稳定地址的一部分 distribution_argument_index integer 仅对分布式函数/过程有效 colocationid integer 仅对分布式函数/过程有效

4.5.14.uxdb mpp_stat_activity

-

功能

显示在所有节点上执行的分布式查询。ux_stat_activity的超集,在后者所在的任何位置都可用。

-

示例

前两个视图包括ux_stat_activity的所有列以及启动查询的工作进程的全局 PID。

例如,考虑对分布式表中的行进行计数:

-- run in one session -- (with a ux_sleep so we can see it) SELECT count(*), ux_sleep(3) FROM users_table;我们可以在uxdb mpp_dist_stat_activity中看到查询:

-- run in another session SELECT * FROM uxdb mpp_dist_stat_activity; -[ RECORD 1 ]----+--- global_pid | 10000012199 nodeid | 1 is_worker_query | f datid | 13724 datname | uxdb pid | 12199 leader_pid | usesysid | 10 usename | uxdb application_name | psql client_addr | client_hostname | client_port | -1 backend_start | 2022-03-23 11:30:00.533991-05 xact_start | 2022-03-23 19:35:28.095546-05 query_start | 2022-03-23 19:35:28.095546-05 state_change | 2022-03-23 19:35:28.09564-05 wait_event_type | Timeout wait_event | PgSleep state | active backend_xid | backend_xmin | 777 query_id | query | SELECT count(*), ux_sleep(3) FROM users_table; backend_type | client backenduxdb mpp_dist_stat_activity视图隐藏内部uxdb mpp片段查询。

要查看这些,我们可以使用更详细的uxdb mpp_stat_activity视图。例如,前面的count(*)查询需要来自所有分片的信息。

其中一些信息位于 shard 中,在下面的查询中可见。

SELECT * FROM uxdb mpp_stat_activity; -[ RECORD 1 ]----+- global_pid | 10000012199 nodeid | 1 is_worker_query | f datid | 13724 datname | uxdb pid | 12199 leader_pid | usesysid | 10 usename | uxdb application_name | psql client_addr | client_hostname | client_port | -1 backend_start | 2022-03-23 11:30:00.533991-05 xact_start | 2022-03-23 19:32:18.260803-05 query_start | 2022-03-23 19:32:18.260803-05 state_change | 2022-03-23 19:32:18.260821-05 wait_event_type | Timeout wait_event | PgSleep state | active backend_xid | backend_xmin | 777 query_id | query | SELECT count(*), ux_sleep(3) FROM users_table; backend_type | client backend -[ RECORD 2 ]+---- global_pid | 10000012199 nodeid | 1 is_worker_query | t datid | 13724 datname | uxdb pid | 12725 leader_pid | usesysid | 10 usename | uxdb application_name | uxdb mpp_internal gpid=10000012199 client_addr | 127.0.0.1 client_hostname | client_port | 44106 backend_start | 2022-03-23 19:29:53.377573-05 xact_start | query_start | 2022-03-23 19:32:18.278121-05 state_change | 2022-03-23 19:32:18.278281-05 wait_event_type | Client wait_event | ClientRead state | idle backend_xid | backend_xmin | query_id | query | SELECT count(*) AS count FROM public.users_table_102039 users WHERE true backend_type | client backend

4.5.15.ux_dist_authinfo

-

功能

ux_dist_authinfo 表包含 uxdb mpp 节点用于相互连接的身份验证参数。

-

列

ux_dist_authinfo列说明

名称 类型 描述 nodeid integer Worker节点表中的节点id,或0,或-1 rolename name uxdb role authinfo text 空格分隔的libpq连接参数 -

示例

开始连接后,节点会查阅表,查看是否存在具有目标nodeid和所需角色名称的行。如果是,则节点在其libpq连接中包括相应的authinfo字符串。一个常见的例子是存储密码,如“password=abc123”。

authinfo中的参数以空格分隔,形式为key=val。要写入空值或包含空格的值,请用单引号将其括起来,例如,关键字 = “value”。值中的单引号和反斜杠必须用反斜杠转义,即\'和\\。

nodeid列还可以采用特殊值0和-1,分别表示所有节点或环回连接。如果对于给定节点,同时存在特定和所有节点规则,则特定规则具有优先权。

SELECT * FROM ux_dist_authinfo; nodeid | rolename | authinfo ---++-- 123 | jdoe | password=abc123 (1 row)

4.5.16.ux_dist_poolinfo

-

功能

如果要使用连接池程序连接到节点,可以使用ux_dist_poolinfo指定内部池的连接信息。此元数据表包含主机、端口和数据库名称,供 uxdb mpp 在通过内部池连接到节点时使用。

如果存在池信息,uxdb mpp 将尝试使用这些值,而不是使用节点默认连接信息去建立内部连接。或者说,在这种情况下,ux_dist_poolinfo信息将取代ux_dist_node。

-

列

ux_dist_poolinfo列说明

名称 类型 描述 nodeid integer 节点信息表ux_dist_node中的节点id poolinfo text 一串以空格分隔的参数:主机、端口、数据库名称 -

示例

-- 如何连接到节点1(如ux_dest_node中所标识的) INSERT INTO ux_dist_poolinfo (nodeid, poolinfo) VALUES (1, 'host=127.0.0.1 port=5433');

4.6.参数配置

一些配置参数会影响到uxdb mpp的使用,包括uxdb本身的参数和uxdb mpp特有的参数。要了解有关uxdb本身参数,请参见《优炫数据库管理系统用户手册》。本节主要讨论uxdb mpp特有的参数。修改uxdb mpp参数类似于uxdb参数的修改,可以修改配置文件或使用SET命令。

4.6.1.通用

-

uxdb mpp.max_worker_nodes_tracked (integer)

此配置值限制哈希表的大小,从而限制工作节点数。此设置的默认值为2048。此参数只能在服务器启动时设置,并且在master节点上有效。

-

uxdb mpp.use_secondary_nodes (enum)

设置在为SELECT查询选择节点时使用的策略。如果将其设置为“always”,则规划器将仅查询在ux_dist_node中noderole列标记为"secondary"的节点。枚举值为:never:(默认)所有读取都发生在主节点上;always:读取针对secondary节点运行,并且禁用插入/更新语句。

-

uxdb mpp.cluster_name (text)

通知协调器节点规划器它协调哪个集群。设置cluster_name后,计划程序将仅查询该群集的工作节点。

-

uxdb mpp.enable_version_checks (boolean)

升级uxdb mpp版本需要重新启动服务器(以获取新的共享库),以及运行

ALTER EXTENSION UPDATE命令。执行这两个步骤失败可能会导致错误或崩溃。此参数是检查代码的版本和扩展匹配的版本。默认是on。在极少数情况下,复杂的升级过程可能需要将此参数设置为off,禁用检查。 -

uxdb mpp.log_distributed_deadlock_detection (boolean)

是否在服务器日志中记录分布式死锁检测相关处理。它默认为off。

-

uxdb mpp.distributed_deadlock_detection_factor (floating point)

设置在检查分布式死锁之前等待的时间。默认值为2。设置值为-1则禁用分布式死锁检测。

-

uxdb mpp.node_connection_timeout (integer)

设置等待连接建立的最大持续时间(以毫秒为单位)。如果在建立至少一个工作节点连接之前超时,uxdb mpp将引发错误。此GUC影响主节点与工作节点之间的连接,以及工作节点与工作节点之间的连接。

参数默认值为30秒,最小值为10毫秒,最大值为1小时。

//设置为60秒 ALTER DATABASE foo SET uxdb mpp.node_connection_timeout = 60000; -

uxdb mpp.node_conninfo (text)

设置用于所有节点间连接的非敏感libpq连接参数。

//由空格分隔的key=value键值对 //例如,ssl选项 ALTER DATABASE foo SET uxdb mpp.node_conninfo = 'sslrootcert=/path/to/uxdb mpp.crt sslmode=verify-full';uxdb mpp 仅支持允许选项的特定子集,如下所示。

-

application_name

-

connect_timeout

-

gsslib

-

keepalives

-

keepalives_count

-

keepalives_idle

-

keepalives_interval

-

krbsrvname

-

sslcompression

-

sslcrl

-

sslmode (默认为“require”)

-

sslrootcert

-

tcp_user_timeout

该设置仅在新打开的连接上生效。要强制所有连接使用新设置,请确保重新加载 uxdb 配置:

SELECT ux_reload_conf(); -

-

uxdb mpp.local_hostname (text)

uxdb mpp节点偶尔需要连接到自身以进行系统操作。默认情况下,他们使用localhost来引用自己,但这可能会导致问题。例如,当主机需要sslmode=verify-full传入连接时,在SSL证书上添加localhost为备用主机名并不总是可取的- 甚至不可行。

uxdb mpp.local_hostname选择节点用于连接到自身的主机名。缺省值为 localhost。

ALTER SYSTEM SET uxdb mpp.local_hostname TO 'mynode.example.com'; -

uxdb mpp.show_shards_for_app_name_prefixes (text)

默认情况下,uxdb mpp会从UXDB提供给SQL客户端的表列表中隐藏分片。这样做是因为每个分布式表有多个分片,这些分片可能会分散SQL客户端的注意力。

GUC uxdb mpp.show_shards_for_app_name_prefixes 允许为指定客户端显示分片。其默认值为''。

-- 仅向uxsql显示分片(在其他客户端中隐藏,如uxAdmin) SET uxdb mpp.show_shards_for_app_name_prefixes TO 'uxsql'; -- 也接受逗号分隔的列表 SET uxdb mpp.show_shards_for_app_name_prefixes TO 'uxsql,ux_dump';

4.6.2.加载数据

-

uxdb mpp.multi_shard_commit_protocol(enum)

该参数时在哈希分布式表上执行复制时要使用的提交协议。对于每个单独的节点,复制在事务块中执行,以确保在复制期间发生错误时不会写入数据。但是,有一种特定情况,即复制在所有节点上都成功,但是提交事务之前发生了错误。此参数可用于在这种情况下通过选择以下提交协议来防止数据丢失:

-

2pc:(默认)在执行复制的时候,首先在各节点使用uxdb的提交为两段提交做准备,然后再由协调节点决定是否执行提交。可以使用

COMMIT PREPARED或ROLLBACK PREPARED手动恢复或中止失败的提交。使用2pc时,应在各个节点上增大参数max_prepared_transactions的值,建议与max_connections相同。 -

1pc:在各个节点中直接提交。有极小的可能会造成数据丢失。

-

-

uxdb mpp.shard_count (integer)

设置hash分布式表的分片总数,默认为32。使用create_distributed_table创建hash分布式表的时候,使用这个值。此参数可在运行过程中设置,即不同的hash分布式表可以有不同的分片总数,此参数只对master上设置有效。

-

uxdb mpp.shard_max_size (integer)

设置append分布式表的分片表最大大小,默认是1GB。即append分布式表的一个分片超过1GB的时候,就会创建一个新的分片。此参数可在运行过程中设置,即不同的append分布式表可以有不同大小的分片,此参数只对master上设置有效。

-

uxdb mpp.replicate_reference_tables_on_activate (boolean)

参考表分片必须放置在具有分布式表的所有节点上。默认情况下,引用表分片在节点激活时复制到节点,即调用uxdb mpp_add_node或uxdb mpp_activate_node等函数时。但是,节点激活可能会给复制带来不便,因为当存在大型引用表时可能需要很长时间。

对此,可以通过将 GUC设置为“off”来延迟引用表复制。设置之后,引用表复制将发生于在节点上创建新分片时。例如,调用create_distributed_table,create_reference_table,或者分片重新平衡器将分片移动到新节点。此GUC 的默认值为“on”。

4.6.3.计划程序

-

uxdb mpp.limit_clause_row_fetch_count (integer)

该参数为

limit子句优化设置每个任务获取的行数。在某些情况下,带有limit的查询子句可能需要从每个任务中获取所有行来生成结果。在这种情况下,设置从每个分片中获取指定的行数,会产生和实际结果有点偏差的近似结果。默认情况下,该参数值是-1,即禁用的。这个参数可以在运行时设置,对master生效。 -

uxdb mpp.count_distinct_error_rate (floating point)

该参数设置计算count(distinct)的容错率。默认是0。如果需要用到此值,建议设置为0.005。此参数可在运行过程中设置,对master生效。

-

uxdb mpp.task_assignment_policy (enum)

设置将任务分配给worker时的策略。master通过计划程序将任务分发到各worker节点上。该参数指定分发任务时使用哪种策略。目前,有三种策略:

-

greedy:默认策略,在worker之间平均分配任务。

-

round-robin:以循环的方式在不同的副本之间交替为worker分配任务。当分片总数小于worker数的时候,可使用这种策略更合适。

-

first-replica:根据插入顺序分配任务,即将任务分配给第一副本所在的worker。

这个参数可以在运行时设置,对master生效。

-

-

uxdb mpp.local_table_join_policy (enum)

此 GUC 确定 uxdb mpp 在本地表和分布式表之间进行

join联接时如何移动数据。自定义联接策略有助于减少在工作节点之间发送的数据量。uxdb mpp将根据需要将本地表或分布式表发送到节点以支持

join联接。复制表数据称为“转换”。如果转换了本地表,则该表将发送给需要其数据来执行联接的任何工作节点。如果转换了分布式表,则会在协调器中收集该表以支持联接。uxdb mpp规划器将仅发送执行转换的必要行。

有四种模式可用于表达转换首选项,如下所示。

-

auto:(默认)uxdb mpp 将转换所有本地表或所有分布式表以支持本地和分布式表联接。uxdb mpp使用启发式方法决定要转换哪个。如果对唯一索引(如主键)使用常量筛选器联接分布式表,它将转换分布式表。这可确保在工作节点之间移动的数据更少。

-

never:uxdb mpp 将不允许在本地表和分布式表之间进行联接。

-

prefer-local:uxdb mpp 更倾向转换本地表以支持本地和分布式表联接。

-

prefer-distributed:uxdb mpp更倾向转换分布式表以支持本地和分布式表连接。如果分布式表很大,则使用此选项可能会导致在工作节点之间移动大量数据。

例如,假设uxdb mpp_table是一个由列x分布的分布式表,并且uxdb_table是一个本地表,如下所示。

CREATE TABLE uxdb mpp_table(x int primary key, y int);

SELECT create_distributed_table('uxdb mpp_table', 'x');

CREATE TABLE uxdb_table(x int, y int);

//联接在主键上,没有常量筛选器

//因此,表uxdb_table将被发送至工作节点以支持联接

SELECT * FROM uxdb mpp_table JOIN uxdb_table USING (x);

//主键上有一个常量过滤器

//因此分布式表中的过滤行将被发送至协调节点以支持联接

SELECT * FROM uxdb mpp_table JOIN uxdb_table USING (x) WHERE uxdb mpp_table.x = 10;

SET uxdb mpp.local_table_join_policy to 'prefer-distributed';

//表uxdb mpp_table将被发送至协调节点以支持联接